飞机、航天器等航空航天产品具有装配过程复杂、装配环节多、装配周期长等特点,这类产品装配过程多以手工作业为主,装配质量和装配效率直接决定了产品的最终性能和交付周期[1]。当前复杂产品装配过程中,操作人员主要参考纸质工艺文件来执行装配任务,易出现因信息表达冗余抽象、可视化程度低和作业人员识图理解困难等导致的错装、漏装等现象[2],因此,迫切需要一种智能可视化的装配引导方法将虚拟装配指令融合到生产第一线以指导装配操作。

自1992 年波音公司技术人员首次提出“增强现实(Augmented reality,AR)”这一概念[3]以来,基于增强现实的智能装配方法为“所见即所得”的装配引导提供了有效解决途径,它借助于AR 技术构建的沉浸式作业环境,将3D 工艺指令等信息叠加在装配现场,增强操作人员感知信息并与之进行交互的能力,对提高航空航天产品装配质量和装配效率、缓解装配现场工人认知负荷具有积极作用[4]。近年来,计算机处理能力的提升,以及传感器和显示技术的快速发展,极大推动了AR 技术从实验室走向工业现场的进程,尤其是如Google Glass、HoloLens、Apple Vision Pro 等消费级混合现实设备的先后出现,在提高人们对AR 技术了解认知的基础上,有力推动了AR 在航空航天等复杂产品装配中的探索与应用[5]。迄今,在AR 辅助装配研究中,国内外相关学者已开展了大量研究工作。本文将在分析AR 装配关键技术基础上,系统论述航空航天装备等复杂产品装配的研究现状及其典型应用进展,并讨论人工智能驱动的AR 装配研究,最后总结和展望航空航天产品AR 装配的发展趋势,为AR 技术在智能装配制造领域的应用部署提供参考。

1 AR 装配辅助关键技术

为实现沉浸式智能装配辅助,AR 装配系统需要具备精准的跟踪注册、自然的人机交互以及友好的可视化显示能力[6]。其中跟踪注册技术可将AR 装配指令以合适的位置和朝向叠加到作业现场,为实现可视化装配指引提供基础。人机交互技术则侧重在沉浸式AR 装配环境下,利用传感器感知和识别算法,实现操作人员与虚拟作业指令间自然友好的信息交流,最终基于合适的图形渲染算法和显示终端,将沉浸式的装配辅助指令以可视化方式准确呈现在作业人员视场中。

1.1 AR 装配中的跟踪注册技术

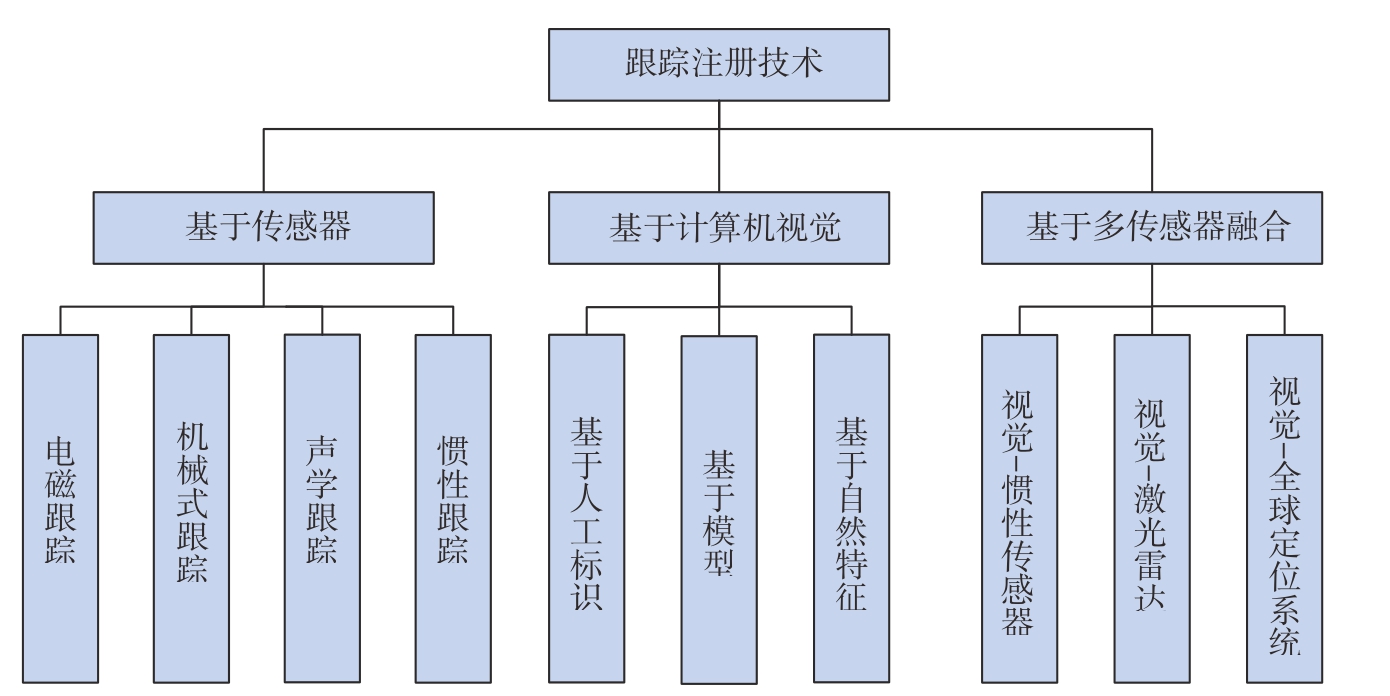

跟踪注册技术是实现AR 装配系统虚实作业指引的关键环节,它决定了虚拟装配指令能否准确、实时地叠加到作业现场,当操作人员移动、旋转或改变视角时,保持虚拟信息与物理环境的几何一致性。对于AR装配系统而言,为形成沉浸式的可视化作业指引效果,需确保跟踪注册过程的持续准确可靠。考虑到工业现场作业人员移动及与现场环境目标进行交互的需求,AR 装配系统位姿感知的响应延迟时间应尽可能短,因此其跟踪注册模块应具备足够高的刷新率。按照具体实现方式的不同,现有AR 装配跟踪注册技术主要可以分为基于传感器的跟踪注册、基于计算机视觉的跟踪注册和基于多传感器融合的跟踪注册,如图1 所示。

图1 航空航天产品AR 装配中的跟踪注册技术分类

Fig.1 Classification of tracking registration technology in aerospace product AR assembly

(1)基于传感器的跟踪注册。

基于传感器的跟踪注册技术通过传感器的信号发射器与感知器来获取相关位置数据,进而计算出AR装配系统相对于物理场景的位姿[7]。文献[8]中总结了几种基于传感器的AR 跟踪注册技术,主要是基于机械式跟踪、电磁跟踪及惯性跟踪等。其中,机械式跟踪利用机械装置各个节点之间已知的角度及位置关系,建立运动学方程求解末端执行器的实时位姿实现跟踪。机械式传感器具有结构简单、可靠性和实时性高的特点,但其操作自由度受限于机械结构,导致灵活性较低,不适用于复杂多变的现场作业环境。电磁跟踪则通过对电磁信号相关参数进行测量来确定被测目标的位置或朝向,其跟踪注册方法可覆盖大范围的应用场景,但易受到信号屏蔽等周围环境的影响,目前尚难以在室内环境提供稳定可靠的跟踪注册结果。由于基于传感器的跟踪注册方法存在易受环境干扰、精度和稳定性受限等问题,当前AR 装配系统相对较少单独采用基于传感器的跟踪注册方法。

(2)基于计算机视觉的跟踪注册。

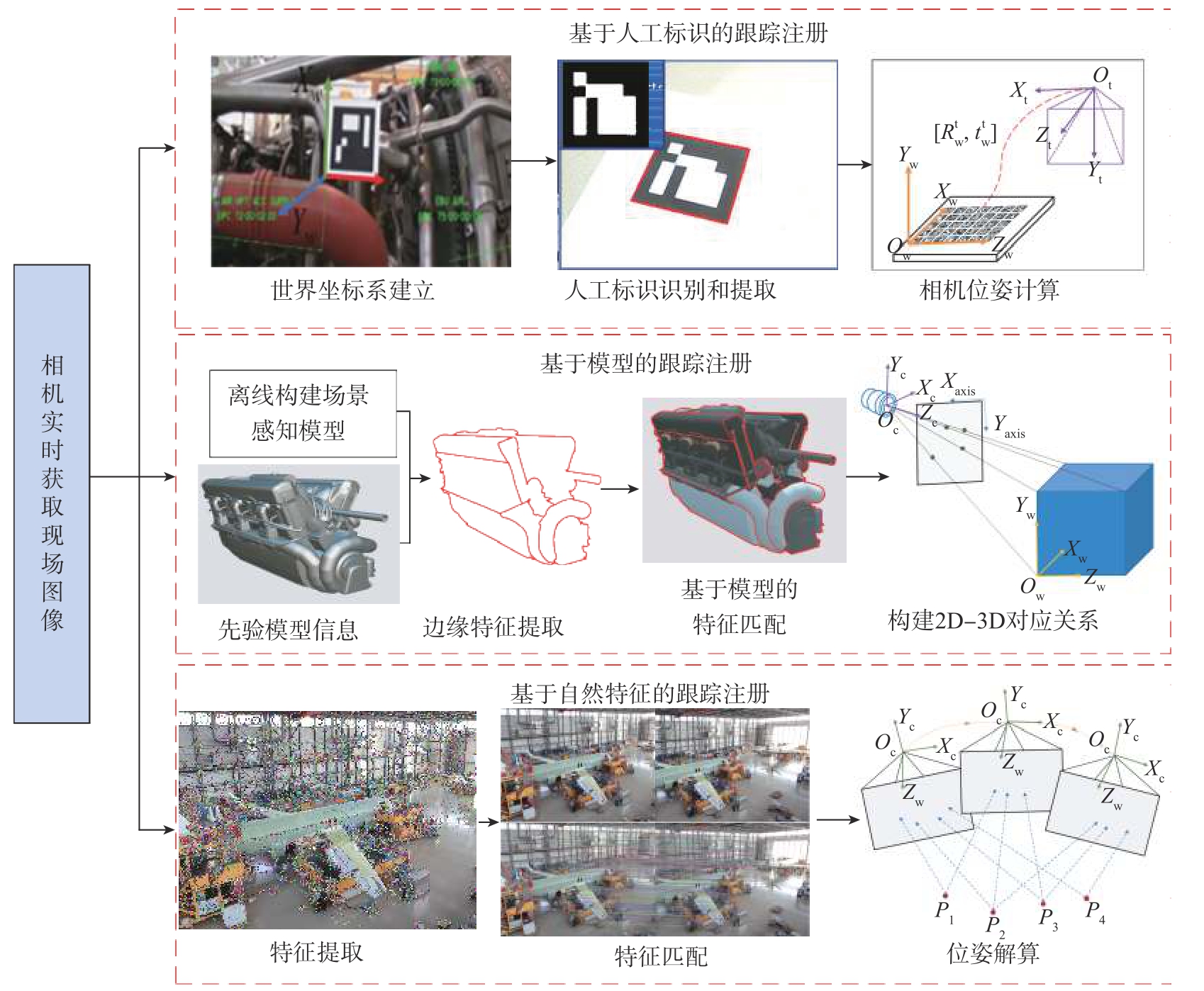

基于计算机视觉的AR 装配跟踪注册方法通过相机获取装配现场的图像信息,构建图像视觉特征和装配现场物理坐标间的映射关系,解算AR 系统在当前装配场景中的位姿。根据图像特征匹配信息的不同,基于计算机视觉的跟踪注册又可进一步细分为基于人工标识、基于模型和基于自然特征的方法[9],具体如图2 所示。

图2 基于计算机视觉的跟踪注册分类

Fig.2 Classification of tracking registration based on computer vision

基于人工标识的跟踪注册方法依赖于待增强场景中粘贴的人工标识(如ARTag[10]、QRCode[11] 等),以之作为待匹配信息,并建立基于人工标识3D 角点的世界坐标系;然后利用相机进行人工标识图像的获取,识别不同人工标识编号,并提取对应的2D 图像角点坐标;在此基础上,根据人工标识角点间的3D-2D 对应关系,通过PnP 算法[12]得到AR 系统相对于该标识的位姿,进而将虚拟作业指令渲染叠加在物理装配现场。基于人工标识的跟踪注册方法计算复杂度低,且具有操作简单、使用方便等特点,但由于需事先在待增强的场景中粘贴人工标识,难以适用于禁止粘贴外来人工标识物的场景,故在实际航空航天产品AR 装配部署中仍存在一定局限。

基于模型的跟踪注册方法则是利用场景中已有零部件的3D 先验模型作为对象,当相机捕捉到与先验模型匹配的2D 图像目标特征时,通过构建当前2D 图像信息与先验3D模型间的约束方程,解算AR 装配系统在物理现场的位姿[13]。基于模型的AR 装配跟踪注册方法虽不需要在工业现场粘贴人工标识,但它依赖于对场景中已有零部件3D 模型等先验信息,故在一定程度上限制该方法在复杂AR 装配场景下的应用。

相较于人工标识特有的视觉侵入性,以及基于模型的跟踪注册方法对先验信息的依赖性,基于自然特征的AR 跟踪注册方法可根据环境中已有的特征(如点、线和纹理等),解算AR 系统在装配现场的位姿,因其友好的环境适应性,近年来在AR 装配中受到了广泛关注。例如,文献[14]借助特征检测算子实现对装配现场自然特征的提取与表达,通过匹配已构建的特征描述库对AR 装配系统进行位姿估计。随着计算机视觉技术的发展,基于视觉SLAM(Simultaneous localization and mapping)跟踪注册算法因避免了对先验特征信息库的依赖,进一步提高了AR 装配的环境适应性。该类方法根据物理现场已有的视觉特征,利用特征检测算子实现对图像特征的提取与描述,并借助图像帧间自然特征匹配和多视几何约束,估计AR 系统在装配现场中的位姿[15]。例如,2015 年Mur-Artal 等[16]提出的ORBSLAM,将SLAM 分为跟踪、地图构建和全局地图优化3 个并行的线程,并增加了闭环矫正策略,有助于AR装配系统获得更精确的跟踪注册结果。但对于弱纹理、光照变化及动态变化的装配现场,基于单一视觉的跟踪注册方法易出现定位失败而导致的AR 误指引现象,使得该方法在实际装配现场的适用性方面存在不足。

(3)基于多传感器融合的跟踪注册。

通过融合不同类型传感器的互补特性,为实际AR 应用提供更为准确的位姿估计的方法,逐渐成为当前移动AR 装配应用的趋势所在。其中,得益于低成本、低功耗和小体积等优势,以基于视觉和惯性融合的跟踪注册方法受到了最为广泛的关注。例如,Campos 等[17]基于预积分思想将视觉ORB-SLAM 算法扩展为基于特征的紧耦合视觉惯性融合SLAM 系统;Qin 等[18]利用单目视觉惯性的互补特性,采用紧耦合的非线性优化方法为AR 系统提供实时位姿估计。

1.2 AR 装配中的人机交互技术

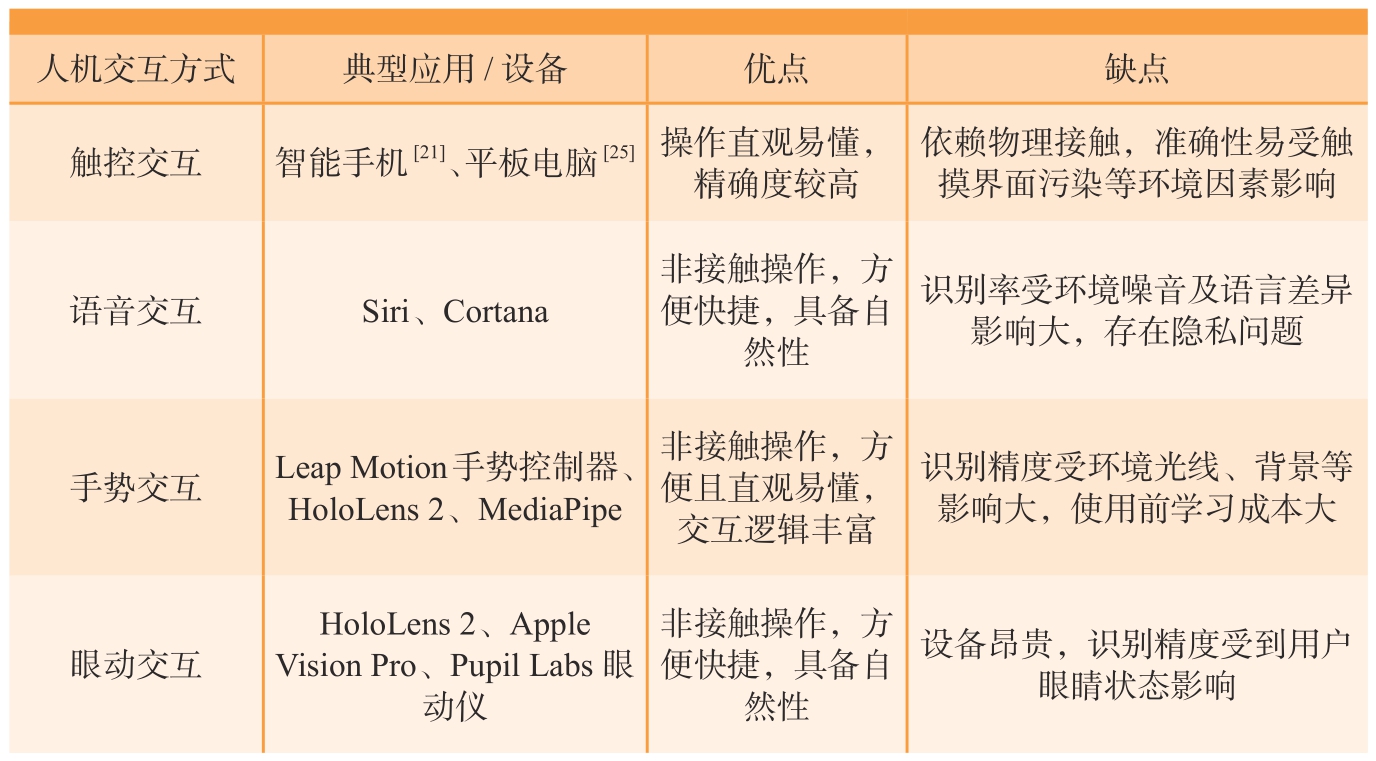

在沉浸式AR 装配过程中,如何构建虚拟装配指令、物理现场以及作业人员间的人机交互通道,是实现“人在环路”智能装配指引的关键。文献[19]中介绍了伯明翰大学教授Alan Dix 的观点,他认为人机交互是研究人、计算机以及它们之间的相互作用方式,目的是使计算机更好地为人类服务。与传统的人机交互不同,AR 装配中的人机交互不仅是操作人员与AR 设备之间的交互,还涉及装配人员与可视化作业指令间的交互[20],并满足交互过程中的自然性、直观性和实时性需求。目前AR 装配系统中的人机交互技术主要有触控交互、语音交互、手势交互及眼动交互等。

触控交互能让人们通过触摸就直接与虚拟装配指令进行互动,操作人员通过手部或手持传感器与可视化标记直接触碰,从而实现与相应数据信息的即时互动和表达。触控交互主要用于触屏式设备中,如平板电脑和移动智能终端,得益于触控交互操作精度较高的优势,该交互方式已广泛应用于各类手持式移动AR 装配系统中[19]。语音交互则主要依赖于自然语言处理技术,通过对传感器采集到的语音信号进行预处理后提取出合适的声学特征参数,将待识别的音频信号与模板库中的样本信号进行匹配,进而识别出相应的命令以实现语音交互[21]。语音识别有助于解放装配人员双手,是一种更为自然、便捷的人机交互方式,但语音交互易受环境噪声的干扰,在实际工业现场易出现识别稳定性不足或误触等现象。手势交互方法是通过基于传感器或基于图像的方式获取操作人员的手部姿态信息,它在识别手工装配动作和作业意图方面具有独特的适应性[22]。相对于语音和手势交互,眼动交互极大缩短了信息加工与动作执行的反应时间,被认为是一种更自然的人机交互范式。在AR 装配中,通常将眨眼、注视和眼跳作为输入信号,通过识别和分析用户的眼球动作来实现与AR 系统的交互控制[23-24]。目前,眼动交互技术尚未大规模普及,但其潜力正在逐渐受到关注和认可,目前主流的消费级AR终端设备中均具备眼动交互功能,如HoloLens 2 和Apple Vision Pro 等,上述人机交互方式的典型应用及特点如表1 所示[21,25]。

表1 航空航天产品AR 装配中典型的人机交互方式

Table 1 Typical human-computer interaction methods in aerospace product AR assembly

人机交互方式 典型应用/设备 优点 缺点触控交互 智能手机[21]、平板电脑[25] 操作直观易懂,精确度较高依赖物理接触,准确性易受触摸界面污染等环境因素影响语音交互 Siri、Cortana非接触操作,方便快捷,具备自然性识别率受环境噪音及语言差异影响大,存在隐私问题手势交互 Leap Motion手势控制器、HoloLens 2、MediaPipe非接触操作,方便且直观易懂,交互逻辑丰富识别精度受环境光线、背景等影响大,使用前学习成本大眼动交互HoloLens 2、Apple Vision Pro、Pupil Labs 眼动仪非接触操作,方便快捷,具备自然性设备昂贵,识别精度受到用户眼睛状态影响

1.3 AR 装配中的显示技术

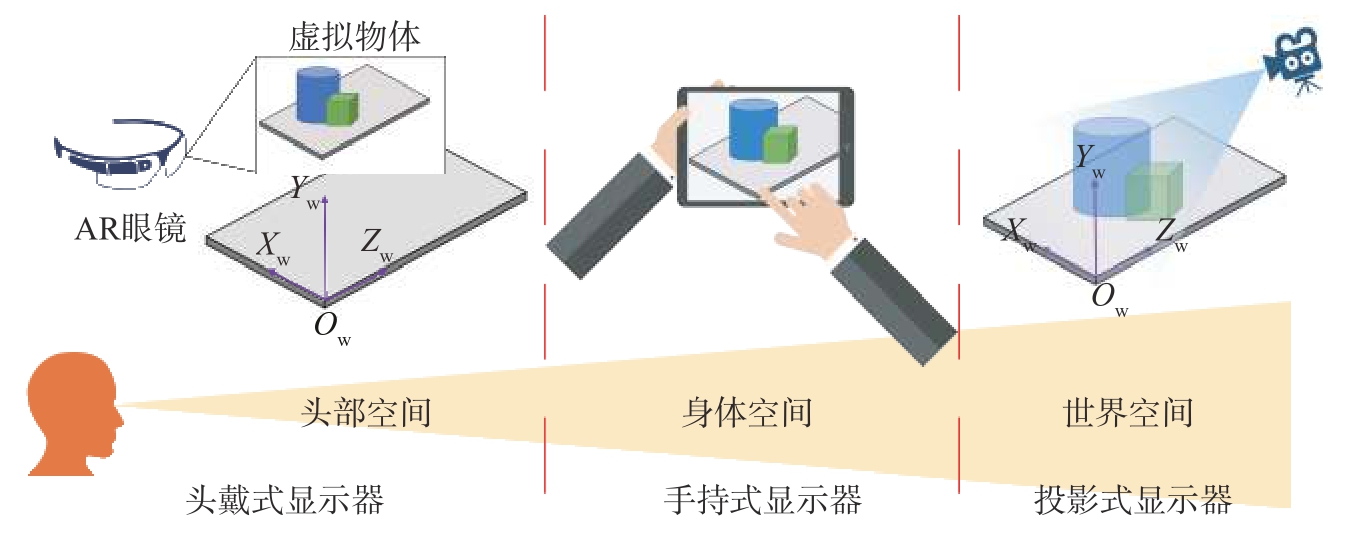

虚实融合后的作业指引通过AR显示技术呈现给操作人员,因此它对AR 显示终端的分辨率和动态范围等特性具有较高要求,以确保虚拟指引信息与真实世界的无缝融合。如图3 所示,根据显示终端设备产品形态,现有AR 装配的显示方式可分为头戴式显示、手持式显示和投影式显示3 种。

图3 AR 装配中的显示技术分类

Fig.3 Classification of display technology in AR assembly

头戴式显示可将工艺指令信息直接呈现在作业人员眼前,按照实现方式的不同可进一步细分为视频透视式和光学投射式[5],其中视频透视式是采用相机实时捕捉周围物理场景视频流,并将虚拟装配指令等信息直接渲染叠加到该视频流上实现虚实融合;光学投射式则是将虚拟的内容直接投射到操作员眼前的半反半透镜片上,使人眼能够观察到虚拟图像与真实装配场景相叠加的场景[26-27]。手持式显示通常借用手持移动终端作为AR 装配的显示设备,它利用设备自带的摄像头来捕捉工业现场视频流,并实时叠加相应的虚拟辅助信息实现AR 作业指引[28-30]。然而,由于操作人员在进行手持AR指引时需占用至少一只手,使得手持式AR 在操作便利性上存在一定局限。投影式显示借助于激光等投射器,直接将虚拟作业指令投射到真实装配现场进行AR 作业指引[22,31-32]。相较于头戴式和手持式方法,投影式显示设备需事先固定在装配现场,因而具有更优的人因舒适性,但由于投影光线易被现场零部件和手势等遮挡,会导致目标指令投影不完整或出现中断等现象,从而破坏虚实融合指引的整体性和连贯性,故此方法更适用于固定场景下较大范围的AR 装配应用。

2 AR 辅助航空航天产品装配研究

在对现有AR 装配辅助的跟踪注册、人机交互及显示等关键技术论述的基础上,本文将进一步梳理和分析近年来AR 装配技术在航空航天领域的研究与应用进展,以期为后续智能AR 装配的现场部署提供参考。

2.1 国内外研究背景

为统计分析近年来国内外学者在AR 辅助航空航天产品装配领域的研究进展,本文首先定义了文献检索标准,从国内外知名学术数据库中收集相关论文,具体包括中国知网、Engineering Village、Web of Science、IEEE Xplore、Springer-Link 和ACM数据库,检索条件:(1)在中文文献的主题中包含“航空”或“航天”或“飞机”,且包含“增强现实”或“混合现实”或“AR”,同时包含“装配”或“增强辅助”;(2)在英文文献的主题中包含“Aircraft”或“Avionics”或“Aerospace”或“Aero engine”或“Satellite”或“Spacecraft”,且 同 时包含“AR assembly”或“Augmented assembly”。

考虑到近年来航空航天产品AR装配的发展历程,本文以上述关键词为搜索条件,检索并收集了近10 年(2014 年1 月—2024 年2 月)来国内外相关文献,最终筛选出同时满足“航空航天”为场景,“装配辅助”为应用以及“AR 技术”为主题的相关文献共计51 篇。对所选择的文献进行统计与分析,如图4(a)所示(其中2024 年1—2 月统计文献2 篇),按AR 显示方式的不同进行分类的文献统计饼图如图4(b)所示(其中,文献[25,30,33-34]同时采用了头戴式及手持式AR 装配技术)。2014—2023 年间,近5 年(2019—2023 年)相关文献数量相较于前5 年(2014—2018 年)有显著增加,虽然在2021—2022 年期间有一定下降,但依据线性回归趋势,在整个时期内,总体文献数呈增长趋势。

图4 AR 辅助航空航天产品装配领域文献统计

Fig.4 Literature statistics on AR-assisted aerospace product assembly

从图4(b)可知,在AR 辅助航空航天产品装配领域中,头戴式AR装配技术成为大多数研究者首选的显示方式,手持式次之,而仅有极少数研究者在航空航天产品装配中采用投影式AR 技术。其原因主要在于头戴式AR 设备在实现虚实信息融合的同时,能够在装配作业环节中“解放双手”;手持式AR 作为次选方案,对操作者的手眼协调能力要求较低,其便携性和易用性受到研究者的青睐,但在沉浸感和操作灵活方面稍显不足;相比之下,当前投影式AR 技术在航空航天产品装配中研究还相对较少,可能是由于它主要适用于固定的作业场景,对现场光照条件和空间布局具有较高要求。

基于显示方式的不同,本文将对头戴式、手持式和投影式3 种不同AR 装配技术在航空航天产品装配领域的典型研究进行论述。不同AR 显示设备辅助装配示意图如图5所示,其中,头戴式AR 技术通过头戴式设备提供沉浸式的虚实融合装配环境;手持式AR 技术通过便携的手持式显示器提供实时的虚拟指导,便于操作与理解;投影式AR 技术将虚拟零部件信息直接投影到实际装配环境中,实现直观无接触的装配辅助。

图5 不同显示设备辅助航空航天产品AR 装配示意图

Fig.5 Illustrative diagram of different display devices assisting aerospace product AR assembly

2.2 头戴式AR 装配技术

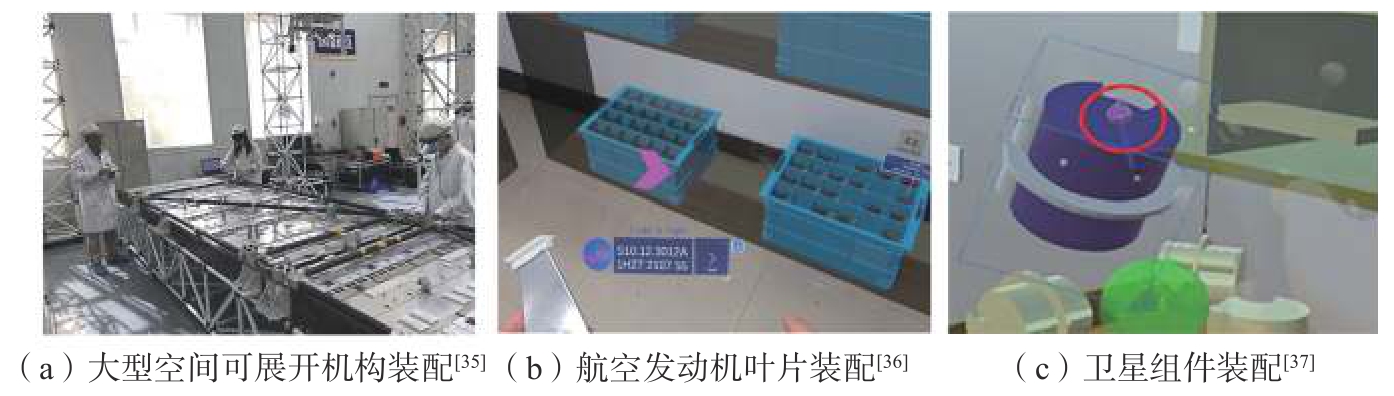

通过头戴式AR 装配技术的头戴式显示器,操作员能够实时获取与真实环境精确叠加的虚拟装配信息,使装配过程中的关键信息以更为直观、立体的方式呈现在眼前。在基于头戴式的AR 装配研究方面,Liu 等[35]针对卫星核心支撑结构中的大型空间可展开机构的装配问题,提出了以人为本的协同装配系统方案,通过AR 眼镜实现真实-虚拟场景融合的自适应装配过程感知(图6(a)),构建装配过程、装配操作人员和装配质量的数字孪生模型,从而减少对工人经验的依赖,降低返工和维修的概率。张杰等[36]开发了一套头戴式AR 辅助引导系统以优化航空发动机叶片的装配过程(图6(b)),该系统基于图像处理、编码识别、AR 可视化信息叠加等技术,实现了叶片识别、物料出入库、零件摆放过程状态检测等功能,提高了装配效率,减轻了工人负担。Bahnmüller 等[37] 基 于HoloLens 眼镜的手势交互功能及6DOF 手持控制器的交互方式开发了AR 应用,对比分析两种交互方式的优劣,并采用该AR 系统实现对卫星装配任务的执行(图6(c))。

图6 头戴式AR 装配技术在航空航天产品装配中的应用

Fig.6 Application of head-mounted AR assembly technology in aerospace product assembly

在应用进展方面,头戴式AR 装配技术凭借其卓越的沉浸感和操作便利性的优势,被广泛应用于国内外航空航天企业相关产品中。中国空间技术研究院自主研发了基于AR 技术的航天总装引导与检测系统(图7(a)),将头戴式AR 眼镜应用于辅助天和核心舱线缆总装的过程中,提高航天器装配的准确性和效率。联想研究院基于5G 和联想晨星AR 头戴式设备,研发了具有连接器智能识别功能的飞机辅助装配系统(图7(b)),构建了基于AR 及计算机视觉的端到端应用解决方案,并应用于中国商飞C919 飞机的线缆插接过程。波音公司借助“Skylight” AR 装配工艺引导系统辅助飞机线缆装配(图7(c)),操作员能够通过该系统直观获取装配指令并进行语音交互,还能与其他操作员协同装配;据数据统计,在AR 眼镜的辅助下,飞机线缆的装配效率提升了25%,装配错误率下降了50%。

图7 航空航天产品装配领域的头戴式AR 装配产品及其应用

Fig.7 Head-mounted AR assembly products and their applications in aerospace product assembly

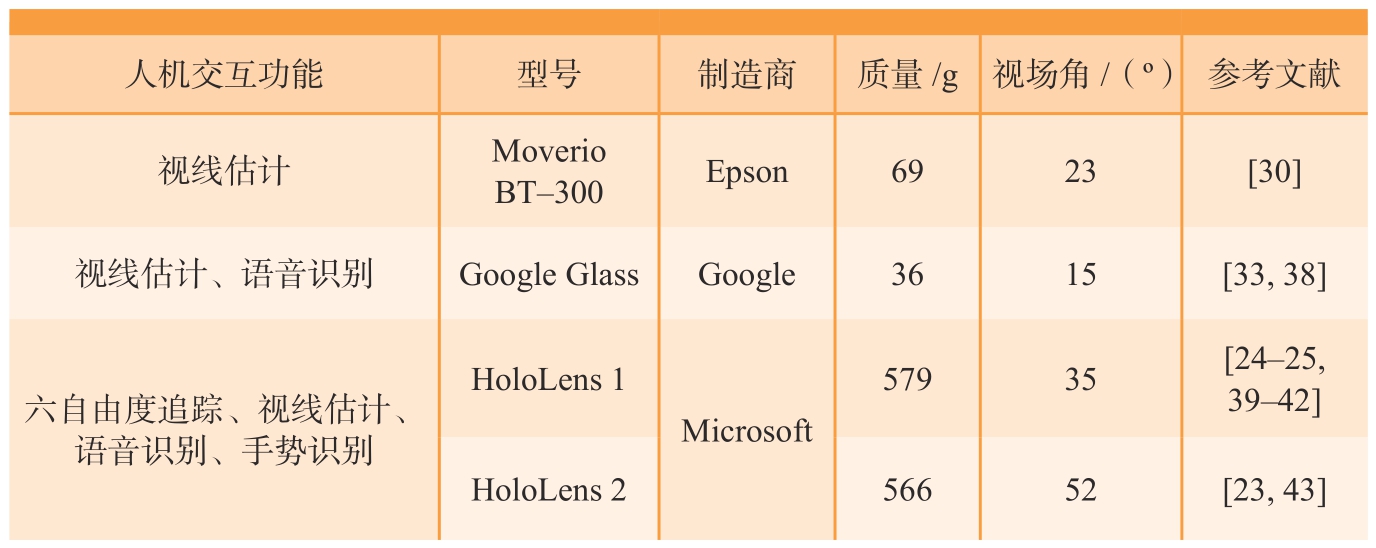

由于能够为用户提供高度沉浸感和丰富的自然交互方式的优势,头戴式AR 装配依然是目前航空航天产品AR 装配的主要方式,但它在设备轻便化、电池续航和人因舒适性方面还存在一定局限。本文对航空航天产品装配领域中典型的AR 应用所采用的可穿戴设备进行统计,如表2所示[23-25,30,33,38-43]。其中,Microsoft HoloLens 系列可穿戴AR 设备在跟踪注册、人机交互和显示等关键技术中表现优异,在航空航天产品AR 装配中受到广泛关注与应用,但受限于其质量较大(约570 g),尤其是在长周期的航空航天产品装配中,人因舒适性方面依然存在较大挑战。

表2 航空航天产品AR 装配中典型的可穿戴设备应用

Table 2 Typical applications of head-mounted devices in aerospace AR assembly

人机交互功能 型号 制造商 质量/g 视场角/(°) 参考文献视线估计 Moverio BT-300 Epson 69 23 [30]视线估计、语音识别 Google Glass Google 36 15 [33, 38]六自由度追踪、视线估计、语音识别、手势识别HoloLens 1579 35 [24-25,39-42]Microsoft HoloLens 2 566 52 [23, 43]

2.3 手持式AR 装配技术

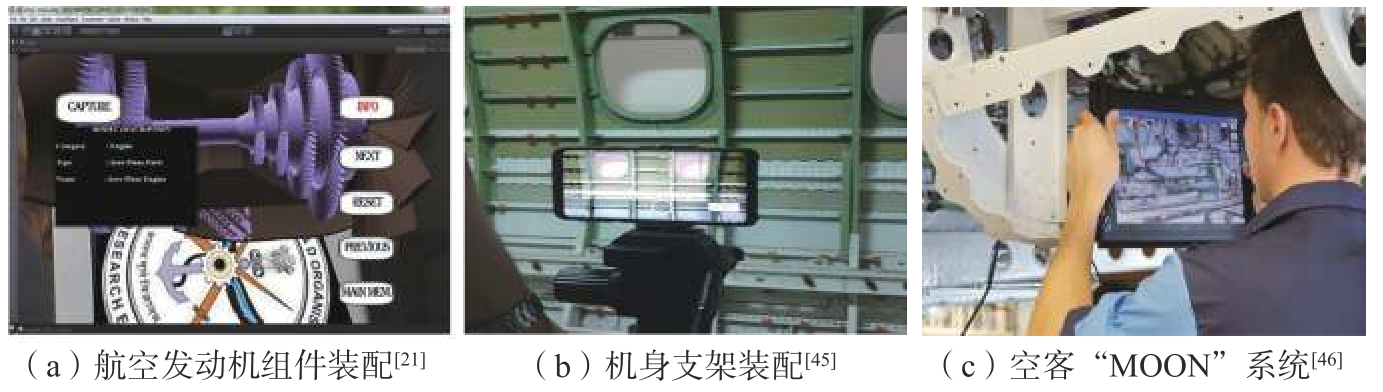

手持式AR 装配技术借助便携式的手持智能终端(如手机、平板等),将虚拟装配辅助信息渲染叠加到该终端获取的现场视频流上,进而实现虚实融合的装配作业指引。得益于现有移动智能终端处理能力的日益提高及其普适性应用,该方法在现场部署方面具有便捷性。如在手持式AR 装配方面,Ma 等[29]针对航空设备装配中组装和拆卸困难等特点,利用手持式AR 设备构建了设备装配辅助系统,并在齿轮油泵的装配过程中进行应用,验证了手持式AR装配技术在航空装配过程应用的可行性。Saban 等[21]开发了1 个AR装配系统来实现航空发动机组件的装配(图8(a)),该系统让用户使用安卓智能手机和Windows PC 进行交互,能够在手机上显示相应模型信息并实现语音朗读功能,提高了操作工人航空发动机组件装配过程中的交互体验。Hu 等[44]借助智能手机和平板电脑等手持式显示器,开发了一种基于AR 和AI 的组合系统用于飞机支架检测,通过该系统可以进行线缆支架的检测与分割,并实时渲染相应虚拟支架的模型,以实现高效、智能的装配辅助。De Souza Cardoso等[45]在三星Galaxy S9+设备中部署了辅助机身支架定位与安装的AR系统(图8(b)),并通过对比分析得出结论,使用该AR 装配应用相较于采用传统方法装配效率更高。在应用进展方面,空客军用飞机公司(Airbus Military)开发了基于平板设备的“MOON”系统[46],该项目使用工业化数字样机和AR 技术,并应用于空客A400M 运输机的辅助装配过程中(图8(c))。基于手持式AR装配方法具有直观易用的优点,适用于需要操作员灵活移动和快速响应的装配任务,但由于移动端设备摄像头相较于人眼视场角更小,场景感知范围受限,因此它在沉浸感和视觉观感自然性方面存在不足,此外,由于手持设备需占用操作员的手,在一定程度上限制了装配过程中作业的灵活性及执行效率。

图8 手持式AR 装配技术在航空航天产品装配中的应用

Fig.8 Application of handheld AR assembly technology in aerospace product assembly

2.4 投影式AR 装配技术

投影式AR 装配技术是通过环境中固定的投影设备将装配工艺指令直接投射到实际工作区域,操作员无需佩戴任何设备即可观察到与真实环境无缝融合的虚拟指导信息。在投影式AR 装配方面,Rupprecht等[47]针对飞机大型装配现场获取装配信息繁琐等缺点,开发了一种AR动态投影系统,直接将装配信息显示在装配组件上进行交互,同时与PC终端的飞机装配演示系统进行试验比较,证实该投影式AR 装配系统在流程改进和可用性方面具有显著优势。秦玉波等[31]利用投影仪、深度相机等设备开发了1 套能够实现工件定位、信息交互与编辑等功能的全流程引导辅助装配系统,并将该系统应用于某航空试验件的紧固件装配过程(图9(a)),通过试验证明该系统能够显著提高装配效率和质量。Xu等[48]基于局部多尺度几何特征向量的快速配准方法,实现大规模紧固件的扫描及定位,开发的三维AR 投影系统将紧固件型号信息及装配指令进行投影从而辅助飞机装配(图9(b)),试验证明该方法可以提高大型结构的装配效率,降低装配错误率。在应用进展层面,达索公司使用Diota 投影系统把数字化指导书直接叠加显示在飞机部件上从而指导装配,将装配制造周期缩短了35%(图9(c))。由于作业过程中操作人员不需要穿戴额外设备,投影式AR 装配技术具有良好的人因舒适性特点,同时便于现场不同作业人员实现虚实场景共享,但该方法需在作业现场事先固定安装投射装置,且在作业过程中易发生因人-机-物动态位置变化导致的投射光线遮挡等问题,所以它主要适用于装配场景相对固定的作业现场。

图9 投影式AR 装配技术在航空航天产品装配中的应用

Fig.9 Application of projection AR assembly technology in aerospace product assembly

2.5 对比与分析

现有典型航空航天产品AR 装配的显示方式统计如表3 所示[21-45,47-70],可知,随着头戴式AR 终端在软硬件和自然交互等方面的日趋成熟,它在现有航空航天产品装配中应用最为广泛。但由于航空航天等复杂产品涉及的装配环节多、装配过程复杂及装配精度要求高等特点,难以通过某一特定的AR 辅助形式完成不同阶段、不同场景下的装配引导任务。如手持式AR 装配技术较为成熟且易于部署,但它在作业过程中难以真正解放双手;头戴式AR 装配在自然人机交互方面具有优势,但在人因舒适性和视场范围方面存在不足;投影式AR 装配具有友好的人因舒适性,但它在现场部署灵活性和投射光线遮挡变形方面存在局限。因此,根据实际现场工况选择合适的AR 显示形式,或采用多种AR 显示方式协同作业形式,对提高AR 装配现场部署及应用效果具有重要意义。未来,航空航天产品AR 装配的应用形态将朝着设备轻量化、操作无感化等方向发展,并结合AR 微显示及复杂计算云化等技术,为AR 装配任务提供更加便捷与高效的解决方案。

表3 航空航天产品AR 装配中显示方式的文献统计

Table 3 Literature statistical analysis of display methods in aerospace product AR assembly

显示技术 优点 缺点 文献头戴式AR 高度沉浸感、交互方式更丰富、灵活性好 便携性受限、成本较高、穿戴舒适性问题有待解决 [23-27, 30, 33-43, 49-62]手持式AR 便携性、交互方式直观、设备易获取 沉浸感不足、灵活性受限 [21, 25, 28-30, 33-34, 44-45, 63-69]投影式AR 便于多人协同、人因舒适性好 依赖外部设备、对环境要求严格、交互易受遮挡 [22, 31-32, 47-48, 70]

3 人工智能驱动的AR 装配研究

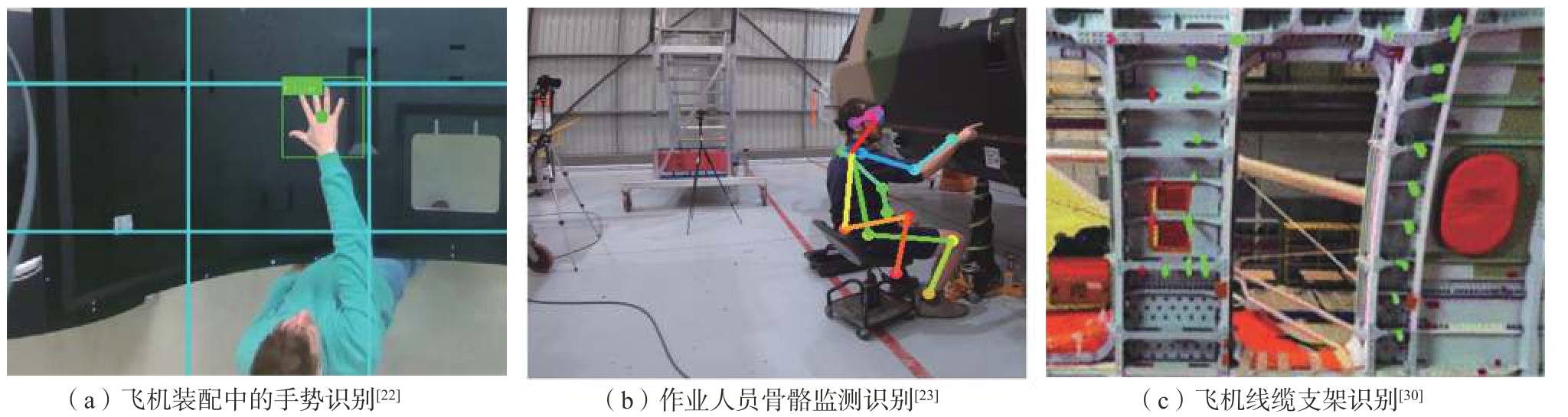

近年来,随着AI 的飞速发展与广泛应用,AI 与AR 技术的融合应用逐渐增多,进一步提升了AR 在航空航天产品装配应用的智能化水平。通过机器学习、深度学习等AI 技术,装配数据得以深度挖掘和分析,实现了AR 装配的智能识别、工艺优化与主动决策推送。Rupprecht 等[22]通过对飞机风扇整流罩的识别实现待增强区域定位,同时结合手势识别对操作员的指令进行判断以辅助飞机装配(图10 (a))。Gulrez 等[23]基于CNN 实时监测作业人员骨骼运动数据,从而评估AR 飞机装配过程中人员的工作负荷,提出通过理解作业人员骨骼的状态实现更智能的人机交互方法(图10(b))。Hu 等[30]提出了一种结合AR 和深度学习的飞机线缆支架检测系统,通过形状匹配进行线缆支架的语义识别与分割,并用不同的颜色进行检测结果的可视化与AR 效果的呈现(图10(c)),从而辅助飞机装配任务。Luxenburger 等[41]搭建了多模态智能调度系统辅助飞机铆接AR 装配,利用对物理世界实测信息构建的分布式模型及中央控制系统,实现状态信息的实时更新、人员的智能调度与任务的高效组织分配。Zhao 等[50]提出了一种基于Mask R-CNN 的飞机线缆支架识别器,基于头戴式AR 设备现场感知的图像实现航空线缆支架的辅助装配。

图10 飞机装配中的语义识别应用

Fig.10 Application of semantic recognition in aircraft assembly

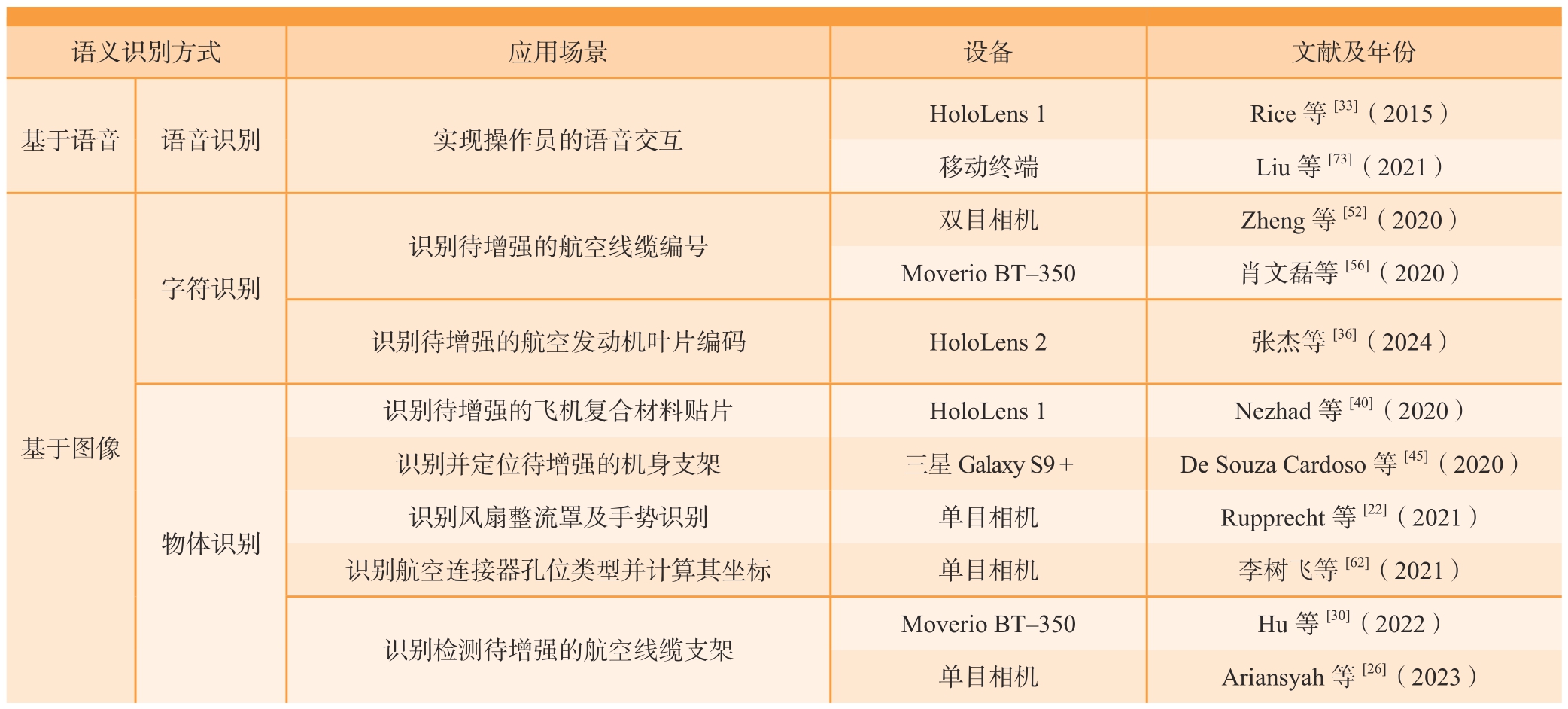

AI 驱动智能制造可从辅助制造系统设计、优化调度管理及自主监管与决策3 个维度进行应用,而对于AI 赋能AR 装配领域的应用则更强调使AR 系统具备对目标的自主检测与跟踪这一能力[71],具体而言,即实现对象的像素级分割与语义归类从而使系统“认识”物理世界的特定目标。在航空航天等复杂产品装配过程中,基于AI 技术对装配现场和装配过程的语义理解,有助于实现“以人为中心”的智能化AR 装配过程,以进一步减少作业人员的认知负荷,提高现有航空航天等复杂产品AR 装配的效率和质量。Ghasemi 等[72]对人工智能驱动的目标检测识别进行系统综述,数据表明自2016 年以来,采用AI 替代传统机器视觉进行语义识别的方法逐渐受到关注,并为装配过程的语义理解提供新的技术手段。本文通过对所检索的文献进行统计分析,发现将AI 应用于航空航天产品AR 装配辅助的研究工作的报道出现于2015 年,Rice 等[33]通过预训练的深度学习模型进行基于语音的语义识别,并结合视觉和语音交互指导飞机线束组装序列的智能调控。近年来,通过AI 赋能航空航天产品AR 装配受到了越来越多的关注,如在线缆支架[30,50]和零部件识别[45,62]等环节,基于AI 对装配现场和装配过程的语义理解,有助于实现AR 装配过程从“被动指引”到“主动提示”的转变,缓解装配现场工人的精神负荷。依据AI 识别过程中信息输入类型的不同,飞机AR 装配中的语义识别类型可分为基于文本的语义识别、基于语音的语义识别及基于图像或视频的语义识别,具体统计如表4 所示[22,26,30,33,36,40,45,52,56,62,73]。

表4 航空航天产品AR 装配中的语义识别技术统计

Table 4 Statistics on semantic recognition technology in aerospace product AR assembly

语义识别方式 应用场景 设备 文献及年份基于语音 语音识别 实现操作员的语音交互HoloLens 1 Rice 等[33](2015)移动终端 Liu 等[73](2021)识别待增强的航空线缆编号双目相机 Zheng 等[52](2020)Moverio BT-350 肖文磊等[56](2020)字符识别识别待增强的航空发动机叶片编码 HoloLens 2 张杰等[36](2024)基于图像识别待增强的飞机复合材料贴片 HoloLens 1 Nezhad 等[40](2020)识别并定位待增强的机身支架 三星Galaxy S9 + De Souza Cardoso 等[45](2020)识别风扇整流罩及手势识别 单目相机 Rupprecht 等[22](2021)识别航空连接器孔位类型并计算其坐标 单目相机 李树飞等[62](2021)物体识别识别检测待增强的航空线缆支架Moverio BT-350 Hu 等[30](2022)单目相机 Ariansyah 等[26](2023)

由表4 可知,相较于基于图像的语义识别,基于语音和文字输入的语义识别技术在航空航天产品AR 装配中的应用较少,可能是因为航空航天产品装配环境通常较为嘈杂,语音指令容易受到干扰而出现误识别现象,而文字输入方式在装配现场操作起来相对繁琐,不利于快速响应和高效执行装配任务,而基于图像的语义识别在航空航天产品AR 装配领域中主要应用于字符或物体识别,进而实现装配过程中工具和零部件的定位和检测。然而,上述基于单一数据类型的语义识别技术依赖于高质量、高精度的现场数据,当面对复杂多变的装配工况时,往往难以获得高质量的训练数据及模型。近年来,随着跨领域数据的深度融合,有效驱动了AR 装配从传统的信息指引逐渐转型为更深层次的信息交互与决策支持,后续如何基于AI 技术实现装配现场信息、工艺数据及人员操作意图等多维信息的实时解析,构建多模态信息感知闭环系统[74],并结合对装配过程的模拟与预测动态调整装配策略[75-76],将有助于推动航空航天产品AR 装配向更高水平的智能化方向发展。

4 结论

虽然AR 辅助的航空航天产品装配已有大量的研究成果,但由于当前计算处理能力和传感器技术等限制,现阶段的航空航天产品AR 装配仍处于早期阶段,距离从实验室走向工业现场的广泛应用还有较长的路要走,它面临的挑战及后续的发展趋势主要有以下4 个方面。

(1)AR 装配的跟踪注册精度和稳定性还有待进一步提高。当前主要以视觉为基础的跟踪注册方法,易受到环境光照变化、动态场景等影响,特别是在航空航天等复杂产品装配现场,其装配周期长、装配环节多等特点对AR 装配指令在现场叠加提出了更高的要求。多传感器协同感知和跟踪注册算法的优化是实现AR 装配系统性能提升的关键,微型化、智能化、集成化的传感技术结合低延时和高稳定性的跟踪注册算法将成为未来发展趋势,通过融合多传感器间的互补信息实现精确感知与协同控制,提高AR 装配系统的整体性能。

(2)现有AR 装配辅助还缺乏自然可靠的多通道人机交互范式。航空航天产品装配中的人机交互技术面临两大主要挑战:一是需要高度个性化和定制化的人机交互以适应复杂多变的操作场景;二是必须确保技术的安全性和稳定性。具备更强扩展性的AI 算法及虚实融合环境的多通道感知与交互技术是应对上述挑战的关键,可通过高效转化专家知识并制定合理的权责边界建立深度表征学习模型,实现对AR 装配行为和认知的调控,如借助工业大模型的深层表征和泛化能力,在操作人员与周围物理环境信息交流的基础上,提高AR 装配系统的自主决策和知识抽取能力,实现场景、物体及人更精确的互认知,以及操作人员与AR系统具身智能之间更优化的交互体验。

(3)现有AR 系统在航空航天产品装配中人因适应性存在不足。现有AR 终端在对现场语义理解和穿戴舒适性方面尚存在不足,导致实际装配任务与可视化交互指引难以并行,也在一定程度上限制了现场工人对AR 装配辅助应用的接受程度。因此,可结合5G/6G 技术的高速低延迟特性,在可控云端环境下完成图像语义理解、大型模型渲染等部分高复杂度的计算工作,以缓解边缘端AR 设备的计算压力,有助于实现更加轻量普适的AR 装配系统,以更好地适应航空航天产品装配长时间、高强度的工作需求。

(4)现有航空航天产品AR 装配过程的虚实信息闭环及主动决策机制还存在不足。当前,航空航天产品装配环节信息往往独立于设计、检测等制造信息,难以形成全流程的主动信息闭环,导致装配过程中人-机-物交互作业数据的实时动态回馈能力不足,未来可进一步探索AR 与数字孪生技术的深度融合机制,集成多维度工艺流程要素、多环节孪生数据模型和装配过程的实时监测与态势预测方法,构建数字孪生驱动的智能AR 装配系统,实现航空航天产品AR 装配系统的自组织、自适应和装配工艺信息的动态调整、智能推送与实时优化。

[1] 刘检华, 孙清超, 程晖, 等.产品装配技术的研究现状、技术内涵及发展趋势[J].机械工程学报, 2018, 54(11): 2-28.

LIU Jianhua, SUN Qingchao, CHENG Hui, et al.The state-of-the-art, connotation and developing trends of the products assembly technology[J].Journal of Mechanical Engineering, 2018, 54(11): 2-28.

[2] LAVRIC T, BRICARD E, PREDA M,et al.ATOFIS, an AR training system for manual assembly: A full comparative evaluation against guides[C]//Proceedings of 2022 IEEE International Symposium on Mixed and Augmented Reality(ISMAR).Piscataway: IEEE, 2022: 558-567.

[3] CAUDELL T P, MIZELL D W.Augmented reality: An application of headsup display technology to manual manufacturing processes[C]//Proceedings of the Twenty-Fifth Hawaii International Conference on System Sciences.Piscataway: IEEE, 1992: 659-669.

[4] WANG Z, BAI X L, ZHANG S S,et al.A comprehensive review of augmented reality-based instruction in manual assembly,training and repair[J].Robotics and Computer-Integrated Manufacturing, 2022, 78: 102407.

[5] FANG W, CHEN L X, ZHANG T N, et al.Head-mounted display augmented reality in manufacturing: A systematic review[J].Robotics and Computer-Integrated Manufacturing, 2023, 83: 102567.

[6] DAMIANI L, DEMARTINI M,GUIZZI G, et al.Augmented and virtual reality applications in industrial systems: A qualitative review towards the Industry 4.0 era[J].IFACPapersOnLine, 2018, 51(11): 624-630.

[7] 韩玉仁, 李铁军, 杨冬.增强现实中三维跟踪注册技术概述[J].计算机工程与应用, 2019, 55(21): 25-34.

HAN Yuren, LI Tiejun, YANG Dong.Overview of 3D tracking registration technology in augmented reality[J].Computer Engineering and Applications, 2019, 55(21): 25-34.

[8] ROLLAND J P, DAVIS L D,BAILLOT Y.A survey of tracking technology for virtual environments[M]//Fundamentals of Wearable Computers & Augmented Reality.London: CRC Press, 2001.

[9] 方维, 许澍虹, 韩磊, 等.AR 增强装配中的跟踪注册方法研究与应用进展[J].系统仿真学报, 2023, 35(7): 1438-1454.

FANG Wei, XU Shuhong, HAN Lei, et al.Research and application progress of tracking registration methods in AR assembly[J].Journal of System Simulation, 2023, 35(7): 1438-1454.

[10] FIALA M.ARTag, a fiducial marker system using digital techniques[C]//Proceeding of 2005 IEEE Computer Society Conference on Computer Vision and Pattern Recognition(CVPR’05).Piscataway: IEEE, 2005: 590-596.

[11] DEFFEYES S.Mobile augmented reality in the data center[J].IBM Journal of Research and Development, 2011, 55(5): 1-5.

[12] LEPETIT V, MORENO-NOGUER F, FUA P.EPnP: An accurate O(n) solution to the PnP problem[J].International Journal of Computer Vision, 2009, 81(2): 155-166.

[13] WUEST H, ENGEKLE T,WIENTAPPER F, et al.From CAD to 3D tracking-enhancing & scaling modelbased tracking for industrial appliances[C]//Proceedings of 2016 IEEE International Symposium on Mixed and Augmented Reality(ISMAR-Adjunct).Piscataway: IEEE, 2016:346-347.

[14] RADKOWSKI R, OLIVER J.Natural feature tracking augmented reality for on-site assembly assistance systems[C]//Proceedings of International Conference on Virtual, Augmented and Mixed Reality.Berlin:Springer, 2013: 281-290.

[15] RUNJI J M, LIN C Y.Markerless cooperative augmented reality-based smart manufacturing double-check system: Case of safe PCBA inspection following automatic optical inspection[J].Robotics and Computer-Integrated Manufacturing, 2020, 64: 101957.

[16] MUR-ARTAL R, MONTIEL J M M, TARDÓS J D.ORB-SLAM: A versatile and accurate monocular SLAM system[J].IEEE Transactions on Robotics, 2015, 31(5): 1147-1163.

[17] CAMPOS C, ELVIRA R,RODRÍGUEZ J J G, et al.ORB-SLAM3:An accurate open-source library for visual,visual-inertial, and multimap SLAM[J].IEEE Transactions on Robotics, 2021, 37(6): 1874-1890.

[18] QIN T, LI P L, SHEN S J.VINSMono: A robust and versatile monocular visualinertial state estimator[J].IEEE Transactions on Robotics, 2018, 34(4): 1004-1020.

[19] 方维.增强现实: 技术原理与应用实践[M].北京: 北京邮电大学出版社, 2022.

FANG Wei.Augmented reality: Technical principles and application practice[M].Beijing: Beijing University of Posts and Telecommunications Press, 2022.

[20] 魏巍, 冯蓬勃, 陈峥廷, 等.增强现实辅助装配技术综述[J].包装工程, 2021,42(14): 108-118.

WEI Wei, FENG Pengbo, CHEN Zhengting, et al.Survey of augmented reality assisted assembly technology[J].Packaging Engineering, 2021, 42(14): 108-118.

[21] SABAN I, NAVEEN KUMAR S K.SPARSHA-AR an android application for the visualization of aero engine components’assemblies and sub-assemblies using augmented reality environment[J].International Journal for Research in Applied Science and Engineering Technology, 2023, 11(7): 73-79.

[22] RUPPRECHT P, KUEFFNERMCCAULEY H, TRIMMEL M, et al.Adaptive spatial augmented reality for industrial site assembly[J].Procedia CIRP, 2021, 104: 405-410.

[23] GULREZ T, KEKOC V, GAURVIT E, et al.Machine learning enabled mixed reality systems—For evaluation and validation of augmented experience in aircraft maintenance[C]//Proceedings of the 7th International Conference on Virtual and Augmented Reality Simulations.New York: ACM, 2023.

[24] MUHAMMAD A S, CHANDRAN K, ALBUQUERQUE G, et al.A suggestionbased interaction system for spacecraft design in augmented reality[C]//Proceedings of 2021 IEEE Aerospace Conference.Piscataway: IEEE,2021: 1-10.

[25] YANG H L, LI S, ZHANG X J, et al.Research on satellite cable laying and assembly guidance technology based on augmented reality[C]//Proceedings of 2021 40th Chinese Control Conference (CCC).Piscataway:IEEE, 2021: 6550-6555.

[26] A R I A N S YA H D, X I K,ERKOYUNCU J A, et al.The impact of different modes of augmented reality information in assisted aircraft cable assembly[C]//Proceedings of Conference on Innovative Technologies in Intelligent Systems and Industrial Applications.Cham: Springer, 2023: 91-100.

[27] MOSCA N, PERNISCO G, DI SUMMA M, et al.Virtual and augmented reality for quality control of aircraft interiors[C]//Proceedings of International Conference on Image Analysis and Processing.Cham: Springer,2022: 225-234.

[28] RAJKUMAR A, EBENEZER H, SNEGDHA A, et al.WITHDRAWN:Augmented reality in aerospace engineering real-time application of AR iOS applications[J/OL].Materials Today: Proceedings, 2020.[2020-12-22].https://www.sciencedirect.com/science/article/pii/S221478532038696X.

[29] MA J S, WANG R, ZHAO J H, et al.Implementation of equipment maintenance and assembly assistance system based on augmented reality[C]//Proceedings of the 2021 5th International Conference on Electronic Information Technology and Computer Engineering.New York: ACM, 2021: 17-21.

[30] HU J Y, ZHAO G, XIAO W L.A comprehensive solution for inspecting cable brackets in aircraft based on augmented reality and deep learning[C]//Proceedings of 8th International Conference on Mechanical Engineering and Automation Science (ICMEAS).Piscataway: IEEE, 2022: 192-196.

[31] 秦玉波, 穆欣伟, 邹方.基于空间增强现实的辅助装配系统研究[J].航空制造技术, 2022, 65(12): 56-62.

QIN Yubo, MU Xinwei, ZOU Fang.Research on auxiliary assembly system based on spatial augmented reality[J].Aeronautical Manufacturing Technology, 2022, 65(12): 56-62.

[32] WANG Z, WANG Y, BAI X L, et al.Micro-information-level AR instruction: A new visual representation supporting manual classification of similar assembly parts[J].Multimedia Tools and Applications, 2023, 82(8):11589-11618.

[33] RICE M, TAY H H, NG J, et al.[POSTER] Augmented wire routing navigation for wire assembly[C]//Proceedings of 2015 IEEE International Symposium on Mixed and Augmented Reality.Piscataway: IEEE, 2015: 88-91.

[34] RICE M, TAY H H, NG J, et al.Extraction, rendering and augmented interaction in the wire assembly of commercial aircraft[C]//Proceedings of 2016 IEEE International Conference on Internet of Things (iThings) and IEEE Green Computing and Communications(GreenCom) and IEEE Cyber, Physical and Social Computing (CPSCom) and IEEE Smart Data (SmartData).Piscataway: IEEE, 2016:349-354.

[35] LIU X Y, ZHENG L Y, WANG Y W, et al.Human-centric collaborative assembly system for large-scale space deployable mechanism driven by Digital Twins and wearable AR devices[J].Journal of Manufacturing Systems, 2022, 65: 720-742.

[36] 张杰, 王淑侠, 何卫平, 等.航空发动机叶片装配执行过程智能检测及AR引导[J].计算机集成制造系统, 2024, 30(4):1263-1272.

ZHANG Jie, WANG Shuxia, HE Weiping,et al.Intelligent detection and AR guidance of aero-engine blade assembly execution process[J].Computer Integrated Manufacturing Systems, 2024, 30(4): 1263-1272.

[37] BAHNMÜLLER A, MUHAMMAD A S, ALBUQUERQUE G, et al.Evaluation of interaction techniques for early phase satellite design in immersive AR[C]//Proceedings of 2020 IEEE Aerospace Conference.Piscataway:IEEE, 2020: 1-8.

[38] ROBERTSON T, BISCHOF J,GEYMAN M, et al.Reducing maintenance error with wearable technology[C]//Proceedings of 2018 Annual Reliability and Maintainability Symposium (RAMS).New York: ACM, 2018: 1-6.

[39] MILLER J, HOOVER M, WINER E.Mitigation of the Microsoft HoloLens’hardware limitations for a controlled product assembly process[J].The International Journal of Advanced Manufacturing Technology, 2020,109(5): 1741-1754.

[40] NEZHAD H Y, WANG X, COURT S D, et al.Development of an augmented reality equipped composites bonded assembly and repair for aerospace applications[J].IFACPapersOnLine, 2020, 53(3): 209-215.

[41] LUXENBURGER A, MOHR J, SPIELDENNER T, et al.Augmented reality for human-robot cooperation in aircraft assembly[C]//Proceedings of 2019 IEEE International Conference on Artificial Intelligence and Virtual Reality (AIVR).Piscataway: IEEE, 2019.

[42] BARANOWSKI A, UTZIG S,FISCHER P, et al.3D spacecraft configuration using immersive AR technology[C]//Proceedings of Virtuelle und Erweiterte Realität-15.Workshop der GI-Fachgruppe VR/AR.Düsseldorf, 2018.

[43] 成昌志, 崔海华, 刘勇强, 等.面向飞机管线装配的多点精准虚实注册方法[J].光学学报, 2024, 44(4): 0412001.

CHENG Changzhi, CUI Haihua, LIU Yongqiang, et al.Multi-point precision virtualreal registration method for aircraft piping and cable assembly[J].Acta Optica Sinica, 2024,44(4): 0412001.

[44] HU J Y, ZHAO G, XIAO W L, et al.AR-based deep learning for real-time inspection of cable brackets in aircraft[J].Robotics and Computer-Integrated Manufacturing, 2023, 83:102574.

[45] DE SOUZA CARDOSO L F,MARIANO F C M Q, ZORZAL E R.Mobile augmented reality to support fuselage assembly[J].Computers & Industrial Engineering, 2020, 148:106712.

[46] SERVÁN J, MAS F, MENÉNDEZ J L, et al.Using augmented reality in AIRBUS A400M shop floor assembly work instructions[C]//AIP Conference Proceedings of 4th manufacturing engineering society international conference.Cudiz: AIP Publishing,2012: 633-640.

[47] RUPPRECHT P, KUEFFNERMCCAULEY H, SCHLUND S.Information provision utilizing a dynamic projection system in industrial site assembly[J].Procedia CIRP,2020, 93: 1182-1187.

[48] XU J, CHEN R, CHEN H P, et al.Fast registration methodology for fastener assembly of large-scale structure[J].IEEE Transactions on Industrial Electronics, 2017,64(1): 717-726.

[49] ZHAO Q J, KONG Y H, SHENG S J, et al.Redundant object detection method for civil aircraft assembly based on machine vision and smart glasses[J].Measurement Science and Technology, 2022, 33(10): 105011.

[50] ZHAO G, HU J Y, XIAO W L, et al.A mask R-CNN based method for inspecting cable brackets in aircraft[J].Chinese Journal of Aeronautics, 2021, 34(12): 214-226.

[51] LI S F, ZHENG P, ZHENG L Y.An AR-assisted deep learning-based approach for automatic inspection of aviation connectors[J].IEEE Transactions on Industrial Informatics,2021, 17(3): 1721-1731.

[52] ZHENG L Y, LIU X Y, AN Z W, et al.A smart assistance system for cable assembly by combining wearable augmented reality with portable visual inspection[J].Virtual Reality &Intelligent Hardware, 2020, 2(1): 12-27.

[53] ZHAO Q, LI X, XU K.Drawing view method based on AR smart glasses for auxiliary assembly operation[C]//Proceedings of 8th International Symposium on Test Automation & Instrumentation (ISTAI 2020).London: IET, 2020.

[54] LI X Y, WU P C, LIN Z W, et al.Design and evaluation of human-computer interface for auxiliary aircraft assembly[C]//Proceedings of 2020 Chinese Automation Congress (CAC).Piscataway: IEEE, 2020:1825-1828.

[55] 唐健钧, 叶波, 耿俊浩.飞机装配作业AR 智能引导技术探索与实践[J].航空制造技术, 2019, 62(8): 22-27.

TANG Jianjun, YE Bo, GENG Junhao.Exploration and practice of aircraft assembly AR intelligent pilot technology[J].Aeronautical Manufacturing Technology, 2019, 62(8): 22-27.

[56] 肖文磊, 邹捷, 冯江伟, 等.基于贝叶斯纠错的AR 辅助飞机装配数据纠错方法[J].航空制造技术, 2020, 63(6): 14-22.

XIAO Wenlei, ZOU Jie, FENG Jiangwei,et al.AR assistant aircraft assembly data error correction method based on Bayesian error correction[J].Aeronautical Manufacturing Technology, 2020, 63(6): 14-22.

[57] 王艺玮, 郭琦, 刘新玉, 等.增强装配工艺信息模型驱动的空间展开机构混合现实辅助装配[J/OL].机械工程学报,2023.[2023-12-21].https://link.cnki.net/urlid/11.2187.TH.20231220.1524.004.

WANG Yiwei, GUO Qi, LIU Xinyu, et al.Assembly of space deployable mechanism driven by enhanced assembly process information model assisted by mixed reality[J/OL].Journal of Mechanical Engineering,2023.[2023-12-21].https://link.cnki.net/urlid/11.2187.TH.20231220.1524.004.

[58] SUÁREZ-WARDEN F, MENDÍVIL E G, RODRÍGUEZ C A, et al.Assembly operations aided by augmented reality: An endeavour toward a comparative analysis[J].Procedia Computer Science, 2015, 75: 281-290.

[59] MEI Y J, LIU Y M, LI J H, et al.Digital twin of large-scale coaxiality measuring instrument with six dimensions: Realizing the unification of aeroengine rotors measurement and assembly[J].IEEE Transactions on Industrial Informatics, 2024, 20(3): 4504-4516.

[60] CERUTI A, MARZOCCA P, LIVERANI A, et al.Maintenance in aeronautics in an Industry 4.0 context:The role of augmented reality and additive manufacturing[J].Journal of Computational Design and Engineering, 2019, 6(4): 516-526.

[61] MCHENRY N, SPENCER J,ZHONG P, et al.Predictive XR telepresence for robotic operations in space[C]//Proceedings of 2021 IEEE Aerospace Conference.Piscataway:IEEE, 2021: 1-10.

[62] 李树飞, 郑联语, 刘新玉, 等.增强现实眼镜辅助的线缆连接器装配状态智能检错方法[J].计算机集成制造系统, 2021,27(10): 2822-2836.

LI Shufei, ZHENG Lianyu, LIU Xinyu,et al.Smart inspection for assembly states of connectors in wiring harness assisted by AR glasses[J].Computer Integrated Manufacturing Systems, 2021, 27(10): 2822-2836.

[63] RICHARDSON T, GILBERT S,HOLUB J, et al.Fusing self-reported and sensor data from mixed-reality training[C]//Proceedings of Interservice/Industry Training, Simulation,and Education Conference (I/ITSEC) 2014.Arlington: National Training and Simulation Association, 2014.

[64] B E N A B D A L L A H H,JOVANČEVIĆ I, ORTEU J J, et al.Automatic inspection of aeronautical mechanical assemblies by matching the 3D CAD model and real 2D images[J].Journal of Imaging, 2019,5(10): 81.

[65] QIU S G, YANG X, SHU Y, et al.Edge-feature-based aircraft cover recognition and pose estimation for AR-aided inner components inspection[C]//Proceedings of 2019 IEEE 8th Joint International Information Technology and Artificial Intelligence Conference (ITAIC).Piscataway: IEEE, 2019:852-860.

[66] SUÁREZ-WARDEN F, MENDÍVIL E G, NEIRA L, et al.I-Tutoring with AR to support decisions in assembly via problem solving for aeronautical transportation[C]//Proceedings of 17th International Conference on Transparent Optical Networks (ICTON).Piscataway: IEEE, 2015: 1-4.

[67] DENEKE C, MOENCK K,SCHÜPPSTUHL T.Notice of removal:Augmented reality based data improvement for the planning of aircraft cabin conversions[C]//Proceedings of 2020 IEEE 7th International Conference on Industrial Engineering and Applications (ICIEA).Piscataway: IEEE, 2020:70-77.

[68] YAO Z J, GAO T H, JIANG X B, et al.An aircraft assembly system based on improved YOLOv5[C]//Proceedings of International Conference on Innovative Mobile and Internet Services in Ubiquitous Computing.Cham: Springer, 2023: 18-28.

[69] H E R N A N D E Z J F E,HERNÁNDEZ E C, PEREZ D A P.Augmented reality for interaction with a CubeSat nanosatellite (ARICS)[J].Journal of Physics:Conference Series, 2023, 2475(1): 012009.

[70] RUPPRECHT P, KUEFFNERMCCAULEY H, TRIMMEL M, et al.Advanced adaptive spatial augmented reality utilizing dynamic in-situ projection in industrial site assembly[J].Procedia CIRP, 2022, 107: 937-942.

[71] SAHU C K, YOUNG C, RAI R.Artificial intelligence (AI) in augmented reality(AR)-assisted manufacturing applications: A review[J].International Journal of Production Research, 2021, 59(16): 4903-4959.

[72] GHASEMI Y, JEONG H, CHOI S H, et al.Deep learning-based object detection in augmented reality: A systematic review[J].Computers in Industry, 2022, 139: 103661.

[73] LIU Y, SUN H L, WANG Q M.Research on AR assisted aircraft maintenance technology[C]//Proceedings of 2nd International Conference on Electronics and Communication,Network and Computer Technology.Chengdu:ECNCT , 2021.

[74] LI W, XU A B, WEI M, et al.Deep learning-based augmented reality work instruction assistance system for complex manual assembly[J].Journal of Manufacturing Systems, 2024, 73: 307-319.

[75] ZHANG C, ZHOU G H, MA D X,et al.Digital twin-driven multi-dimensional assembly error modeling and control for complex assembly process in Industry 4.0[J].Advanced Engineering Informatics, 2024, 60:102390.

[76] GARCÍA Á, BREGON A,MARTÍNEZ-PRIETO M A.Digital twin learning ecosystem: A cyber-physical framework to integrate human-machine knowledge in traditional manufacturing[J].Internet of Things, 2024, 25: 101094.