在航空航天领域,焊接工艺广泛应用于大型零件的生产。但由于设计和操作中的各种人为及随机因素,焊缝中不可避免地存在气孔、裂纹、夹渣等缺陷[1]。因此,在生产和操作过程中,有必要对焊缝中的缺陷进行检查,以确保产品在生产及运行中的安全。X 射线检测被广泛应用于大型零件焊接质量检测[2]。对于某些复杂的测量场景,例如复杂管路缺陷检测等,X 射线检测无法采用数字式接收器,仅能使用X 射线胶片充当信息记录的载体。将X 射线胶片转化为数字图像是缺陷智能识别的基础和前提,如何避免模糊图像信息丢失,实现高保真数字化是有待解决的难点问题。目前针对X 射线图像的焊缝缺陷检测方法是人工判读,将胶片置于观察灯上,通过人眼观察焊缝缺陷[3]。然而,这种方法存在一些缺点:首先,该方法抽样率低,不能准确反映焊接质量;其次,该方法实时性差,远不能满足高速生产节奏;最后,该方法缺乏检测的一致性和科学性,导致检测的可靠性较低。随着航空航天加工向自动化、敏捷化、数字化方向快速发展,传统人工焊缝质量评估存在主观性大、效率低、对底片损伤大等缺点,已不能满足大批量生产和数字化信息管理的需要。针对X 射线胶片的数字化及人工智能判读,多数研究集中在对医学X 射线胶片的数字化翻拍以及人工智能辅助医疗上。由于人体对X 射线的穿透率高,医学X 射线胶片的光学密度(黑度)相对于工业X 射线胶片低很多,易于实现对医学X 射线胶片的数字化,但这些方法不能直接用于工业X 射线胶片的数字化,而必须采用高动态范围图像的融合技术。此外,医学辅助医疗人工智能是在前期大量先验临床病例的基础上实现的,是经过大训练样本进行训练学习的神经网络,同样不适用于航天制造过程中产生缺陷产品少的小训练样本的情况。因此,寻找一种能够实现焊缝缺陷高质量数字图像转化和自动识别的方法对航空航天制造的数字化、自动化、智能化建设具有重要意义。

目前针对X 射线焊缝图像缺陷检测的研究大部分采用图像阈值分割的方法,吴一全等[4]提出了基于对称Tsallis 交叉熵及背景与目标面积差的小目标图像阈值分割方法,对于图像小目标特征分割具有明显优势。陈本智等[5]针对厚钢管焊缝X射线图像的气孔缺陷提出了一种新的无监督学习的各种气孔缺陷检测算法,基于图像重构的思想实现对气孔特征的分割,但对于裂缝等其他类型缺陷的检测精度较差。近年来,基于卷积神经网络的图像检测算法也被广泛应用于目标识别与检测领域。He 等[6]为了提高钢产品表面缺陷检测的准确性,提出了一种新的多组卷积神经网络目标检测框架,并在不同的钢生产线上进行了大量试验,结果显示该方法与已有的缺陷检测方法相比具有更优的检测能力。Yu 等[7]提出了一种复杂背景下齿轮缺陷在线检测的S–YOLO 模型,并在复杂背景下齿轮缺陷在线检测试验平台上进行了验证。Mei 等[8]提出了一种基于无监督学习的自动检测和定位织物缺陷的方法,无需任何人工干预,该模型是一种多尺度卷积去噪自编码结构。总之,深度学习算法可以通过多层次网络架构对原始输入的数据集进行逐层提取与抽象处理以准确确定目标缺陷位置。本文研究的大型零件焊缝缺陷具有小目标特点,并且零件X 射线胶片中焊缝区域的焊接波纹使背景变得复杂,对缺陷的识别产生干扰,传统图像分割算法与深度学习图像检测算法难以对焊缝中的缺陷实现准确识别。

本文面向大型零件提出了一种X 射线胶片数字化和缺陷自动识别的新方法,设计了两种卷积神经网络,一种用于提取焊缝区域以获得更好的数字效果;另一种用于检测数字图像的缺陷。通过对大型零件的X射线胶片中的焊缝缺陷进行检测试验,验证了所提出的胶片数字化和缺陷检测方法具有良好的效果。

1 大型零件X 射线胶片数字化处理

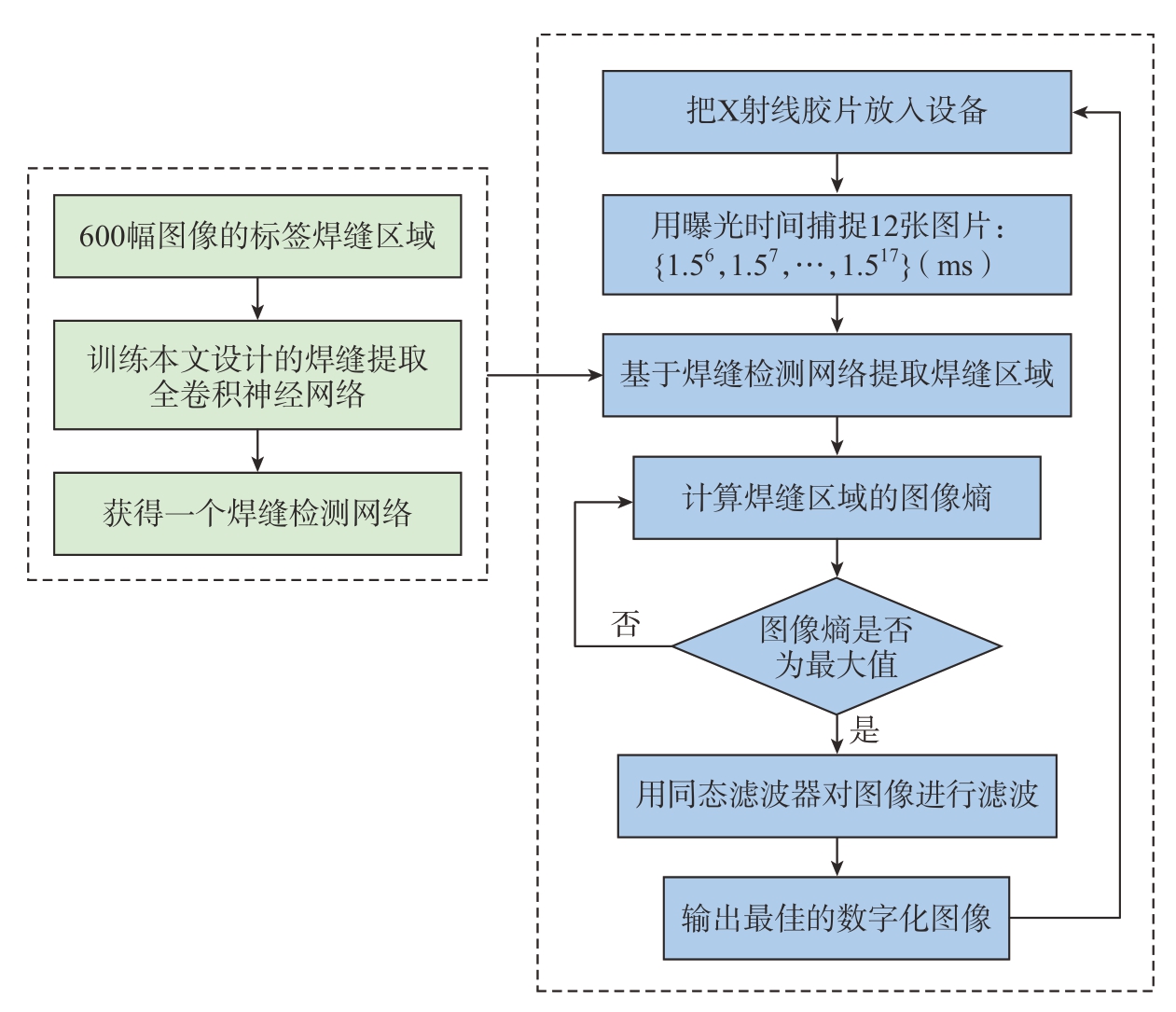

在航空航天产品中,影响X 射线胶片数字化效果的因素主要有以下4 个方面:(1)为了便于管理,X射线胶片中存在着透射光强的数字标记和三角形标记,其亮度和对比度远高于焊缝区域,给后续图像处理带来强烈的干扰;(2)数字图像中背景灰度信息复杂;(3)焊缝在产品不同部位的形状不同,在X 射线胶片中的位置也不同,仅根据焊缝区域的灰度信息确定数字化效果时,很难提取固定位置的焊缝信息;(4)不同X射线胶片的黑度不同,达到适当亮度所需的光源强度变化很大[9]。因此,为了实现X 射线胶片的自动数字化,本文采用了基于全卷积网络的数字化方法,其流程图如图1所示。

图1 数字化方法流程

Fig.1 Flow of digital method

对于不同黑度的X射线胶片,获得合适亮度的数字化图像所需的光源强度是不同的。在图像采集过程中,光源强度的调整与相机曝光时间的调整具有相同的效果,而相机曝光时间的调整可以提高数字化图像的精细度和准确性,因此选择调整曝光时间的方法。通过对大量X 射线胶片的图像采集,得到了每张X 射线胶片获得最佳数字效果所需的曝光时间。对这些最佳曝光时间数据进行函数拟合,得到拟合函数

式中,T 是曝光时间,ms。

为了自动获得最佳的数字化图像,增加后续检测所需的图像数据量,本文对每一个目标采集了12 张曝光时间的图像,即每张X 射线胶片取包含{1.56,1.5 7,…,1.517}共12 张不同亮度的数字化图像,其中包括曝光时间最佳的数字化图像。

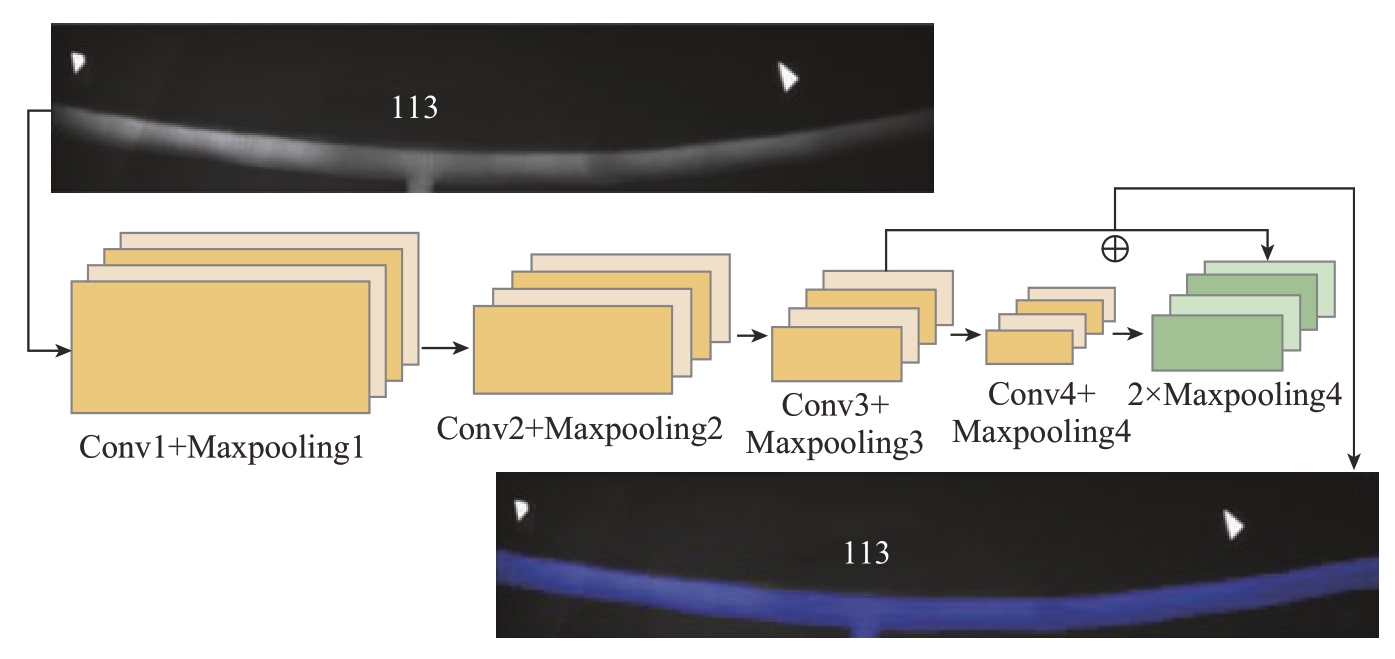

为了在12 张数字化图像中自动选择曝光时间最好的图像,首先需要提取焊缝区域。航空航天产品不同位置的焊缝形状不同,焊缝位置也存在差异。为了准确检测焊缝区域,本文设计了一种基于全卷积神经网络的专用卷积神经网络,用于焊缝区域的提取,网络结构示意图如图2所示。该网络对图像进行像素级分类,每个像素都有一个是否属于焊缝区域的概率值,因此可以在语义层面上解决图像分割问题[10]。与经典的目标分类网络不同,该网络没有完全连通的层,而是将全连通层替换为反卷积层,将多个池化层执行向下采样运算后向上采样得到与输入图像尺寸大小相同的特征映射。因此,该网络可以在预测图像中每个像素的同时保留原始输入图像中的空间信息。最后,对上采样的特征映射进行逐像素分类。由于网络中没有完全连接的层,因此输入网络的图像可以是任意大小。

图2 X 射线胶片数字化网络结构

Fig.2 Digital network structure diagram of X-ray film

在本节的数字化网络中有4 个池化层,输入图像可以实现16 次下采样运算。网络结构中定义了一个跳跃架构,将来自较深、粗层的语义信息与来自较浅、细层的外观信息结合起来,以产生准确而详细的分割。最后,将pool3 的输出与pool4 的输出的2 倍上采样相融合,通过步幅预测运算对图像进行上采样处理。

在进行网络训练之前,需要标注曝光时间与焊缝区域。标注时,只对未过度曝光的焊接区域进行标记,过度曝光的焊接区域是非目标区域。因此,同一X 射线胶片在不同曝光时间下的图像与焊缝面积存在特征差异。通过对50 张X 射线胶片采集的600 幅图像进行标记,输入到训练网络中,得到训练好的焊缝检测网络。本文将图像中检测到的面积值最大的焊缝区域作为这张X 射线胶片数字化图像的焊缝区域。

图像熵表示图像中灰度分布的聚合特征所包含的信息量。曝光时间较短的图像与曝光时间较长的图像均会影响灰度信息量的丰富性。本文通过计算焊缝区域的图像熵来确定最佳的数字化图像,定义为

式中,pi 是指灰度值i 出现的概率值,可以从灰度直方图中得到。

根据以上分析,参考文献[11]中的理论,定义图像熵值最大的图像为曝光时间最好的数字化图像。

受射线能量、产品厚度、加工方法、透射角度等多种因素的影响,X射线胶片的一些数字图像具有光强不均匀的特点。为了获得良好的数字效果,在算法中引入了一种同态滤波器,以最佳曝光时间对数字化图像进行滤波。同态滤波是一种将频率滤波和空间灰度变换相结合的图像处理方法。一幅图像可以被视为由照射分量函数和反射分量函数组成,即对原始图像进行对数变换,得到两个叠加分量,即

对对数图像进行傅里叶变换,得到相应的频域为

然后设计了式(6)的频域滤波器函数对对数图像进行频域滤波。

式中,c为指定的非负数;D0为截止频率;D(u,v)为(u,v)到滤波器的中心的距离。

最后,对上述结果进行傅里叶反变换,得到空间域内的对数图像,再取指数得到空间滤波结果。

2 基于卷积神经网络的缺陷检测算法

通过对数字化图像数据集中的焊缝缺陷特征进行分析,发现焊缝中的缺陷如气孔、夹钨、裂缝均具有小目标特点,缺陷的标注面小于1024像素。传统的深度学习算法对小目标进行检测时识别精度较差,原因主要有两点:(1)小目标缺陷的分辨率低,携带的有效信息很少,致使其难以准确表达特征,影响卷积神经网络的特征提取能力;(2)在检测模型中,输入的数字化图像通过主干网络的下采样运算后到达分类回归层,某些小目标缺陷的接受域映射回原始图像时尺寸会发生变化,导致检测精度差。将特征金字塔网络(Feature pyramid network,FPN)引入到主干网络与分类回归网络中,使其能够融合不同维度的特征映射信息,从而使小目标缺陷在低层特征映射中具有较大的分辨率与丰富的语义信息,最终增强小目标缺陷的特征信息。

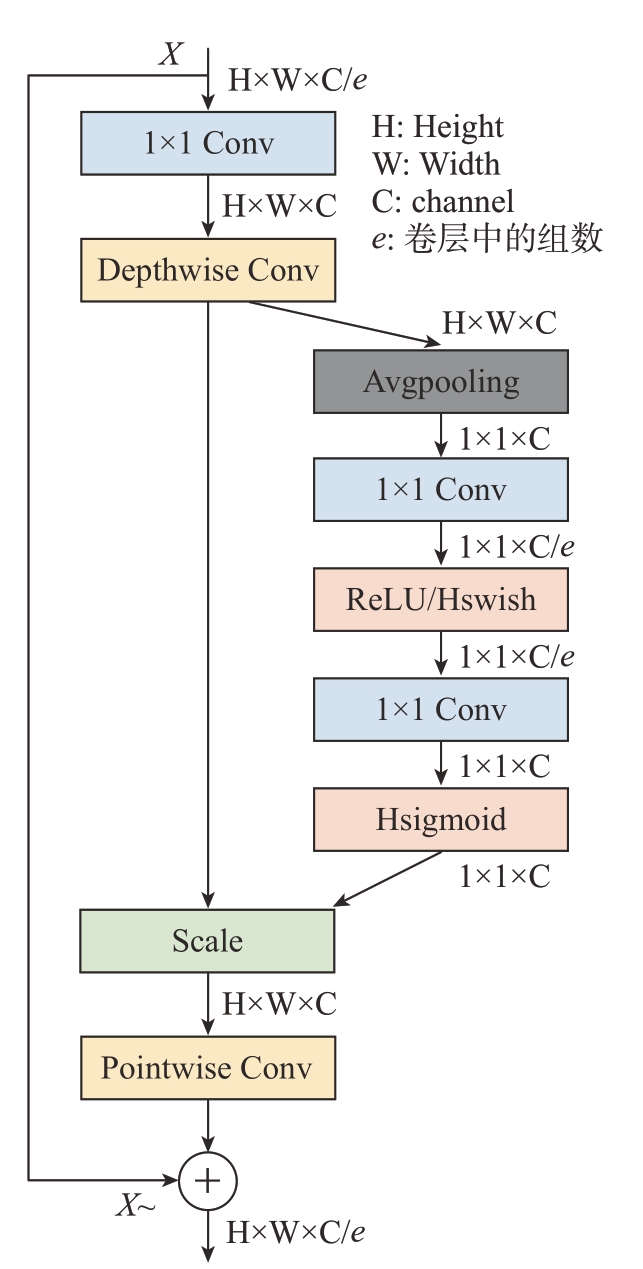

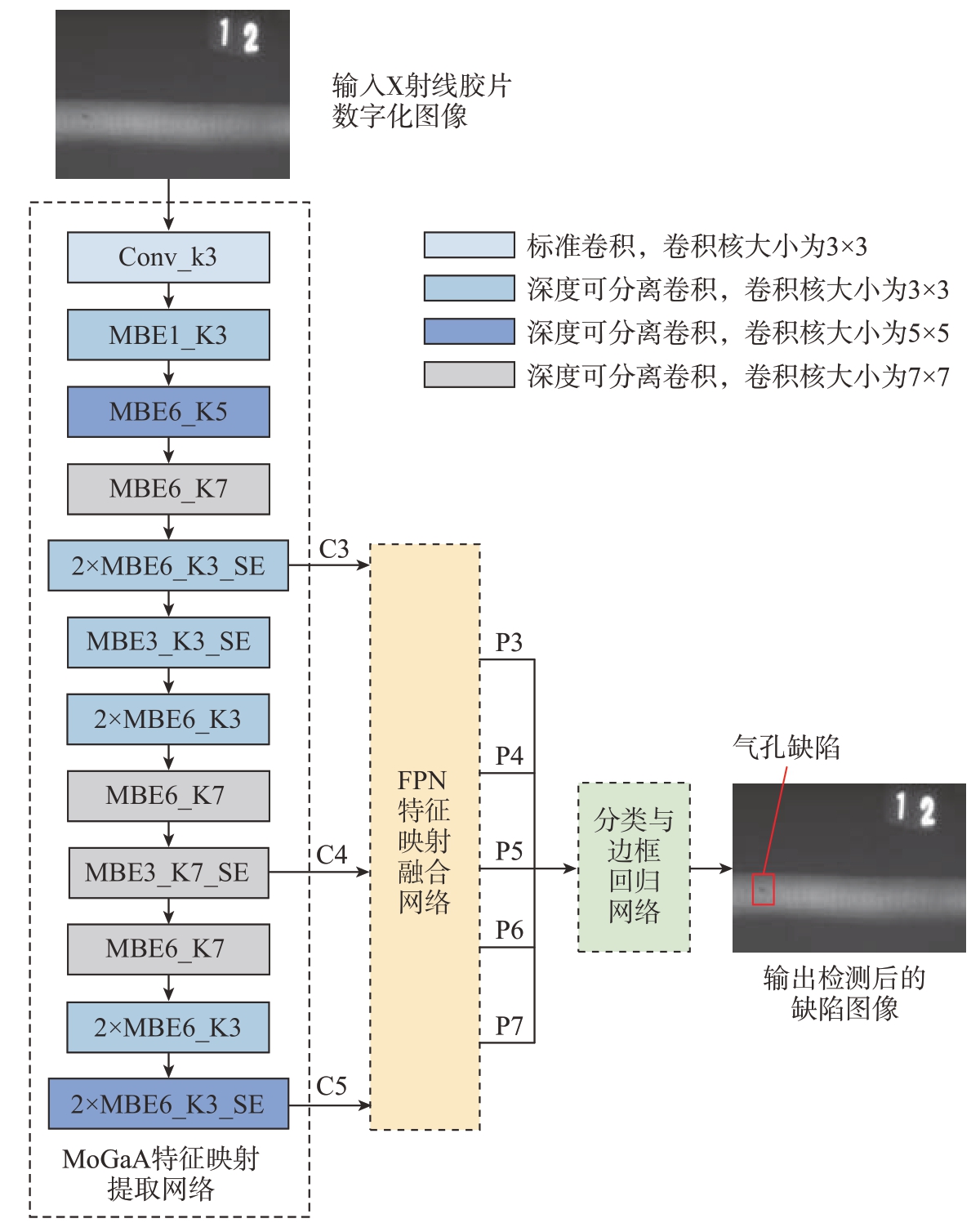

更大的主干网络能够提高缺陷检测的精度,但会造成更高的时间成本,因此本文选择轻量级网络MoGaA[12](MobileGPU–Aware–A)作为算法的主干网络,建立MoGaA–RetinaNet 检测算法。该模型的主要思想是将特征提取网络RetinaNet 替换传统算法中的主干网络ResNet。如图3所示,MoGaA 网络的主干部分包含14 个倒置模块,其中倒置残差模块的结构如图4所示,该结构由挤压激励单元(Squeeze-and-excitation,SE)、残差单元(Residual module)、深度可分离卷积(Depthwise separable convolutions)组成[13–14]。

图4 倒置残差模块结构

Fig.4 Inverted residual module structure

在图3所示的MoGaA–RetinaNet模型中,第4 层、第9 层及第14 层残差模块输出的特征映射C3 ~ C5 输入到FPN 网络中,C3 特征映射的尺度为40 × 40 × 160,C4为20 × 20 × 80,C5为10 × 10 × 160。在FPN 特征映射融合网络中,首先将特征映射尺度最小的C5 利用卷积运算得到P5。为了融合不同的深度信息,对P5 进行2 倍上采样运算,放大尺寸为原来的2 倍,然后与卷积运算后的C4 结合生成P4,同理对P4 进行2 倍上采样运算,放大两倍后与经过卷积运算的C3 组合得到P3。最后,为了提取缺陷图像中深层次的语义信息,对P5进行两次3×3 的卷积运算得到P6与P7。经过以上运算,在FPN 网络中共生成了P3~P7 5 个特征映射,将这些结果分别输入到分类与回归网络中,得到X 射线胶片数字化图像的焊缝缺陷位置和类别信息。图3 的深度可分离卷积单元MBEx_Ky_SE中,Ex 表示扩展层的扩展速率为x;Ky 表示深度卷积层卷积核的大小为y;SE为挤压激发层。

图3 MoGaA–RetinaNet 网络结构

Fig.3 Network structure of MoGaA–RetinaNet

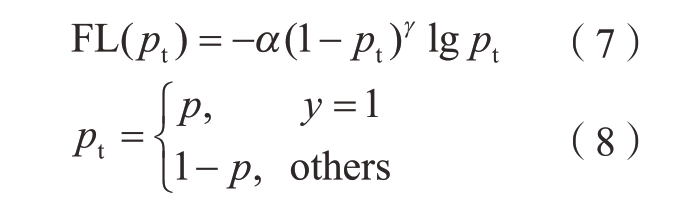

在本节提出的缺陷检测算法中,主干网络首先将特征映射输入到分类与回归子网络中,通过构建损失函数来反映网络输出值与期望值的差异,然后根据损失值进行反向传播(Back propagation,BP)求解梯度,进而更新网络中的权重系数,使前向传播的误差值越来越小,最终使训练出的模型能够更加准确地识别目标缺陷。本文的网络结构中,分类与边框回归网络的损失函数继承了RetinaNet 网络的损失函数,设置分类网络的损失函数为焦点损失函数(Focal loss),该函数能够解决训练过程中正负样本不平衡导致的分类偏差问题。焦点损失函数为

式中,α 与γ 是超参数,用来调节难易样本对损失函数权重的影响,通过合理设置α 与γ 增强困难样本对损失函数的贡献,削弱易识别样本对损失函数的贡献,本文中取α=0.25,γ=2;p 是模型估计的概率;pt 则是在二分类情况下对应模型估计的概率。

3 试验及结果

3.1 X 射线胶片数字化处理

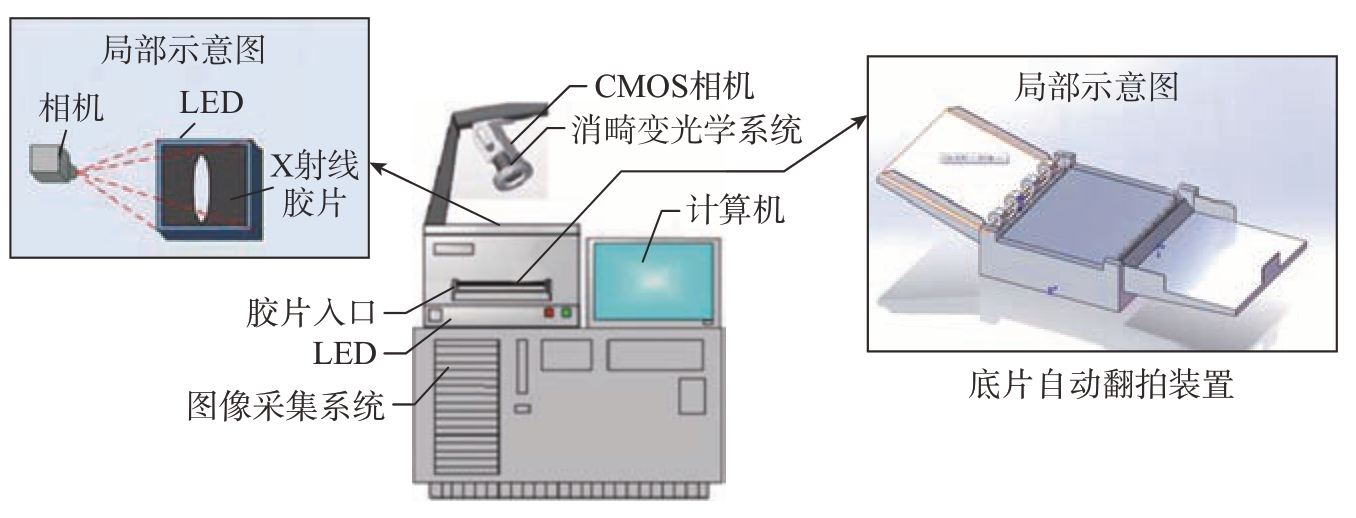

由于X 射线胶片的黑度较大,焊缝与背景的对比度较低,现有的数字扫描仪扫描的数字化图像丢失了很多细节,导致图像质量下降,不能满足缺陷检测对图像质量的要求。为了解决这些问题,本文采用了由强光源、工业CMOS 相机、施耐德高品质镜头和计算机组成的数字系统。强光源是亮度可调的高强度光源,具有漫反射面板,使整个面板的光强均匀。设备系统图如图5所示,利用该系统可以得到多幅图像。本文算法是基于Pytorch1.7.1 实现的,使用的编程语言为Python3.9,试验所用的计算机配置为Intel(R)Xeon(R)Gold 6144 CPU 3.50 GHz,使用的视觉库为Opencv,深度学习框架为Tensorflow。

图5 设备系统示意图

Fig.5 Diagram of equipment system

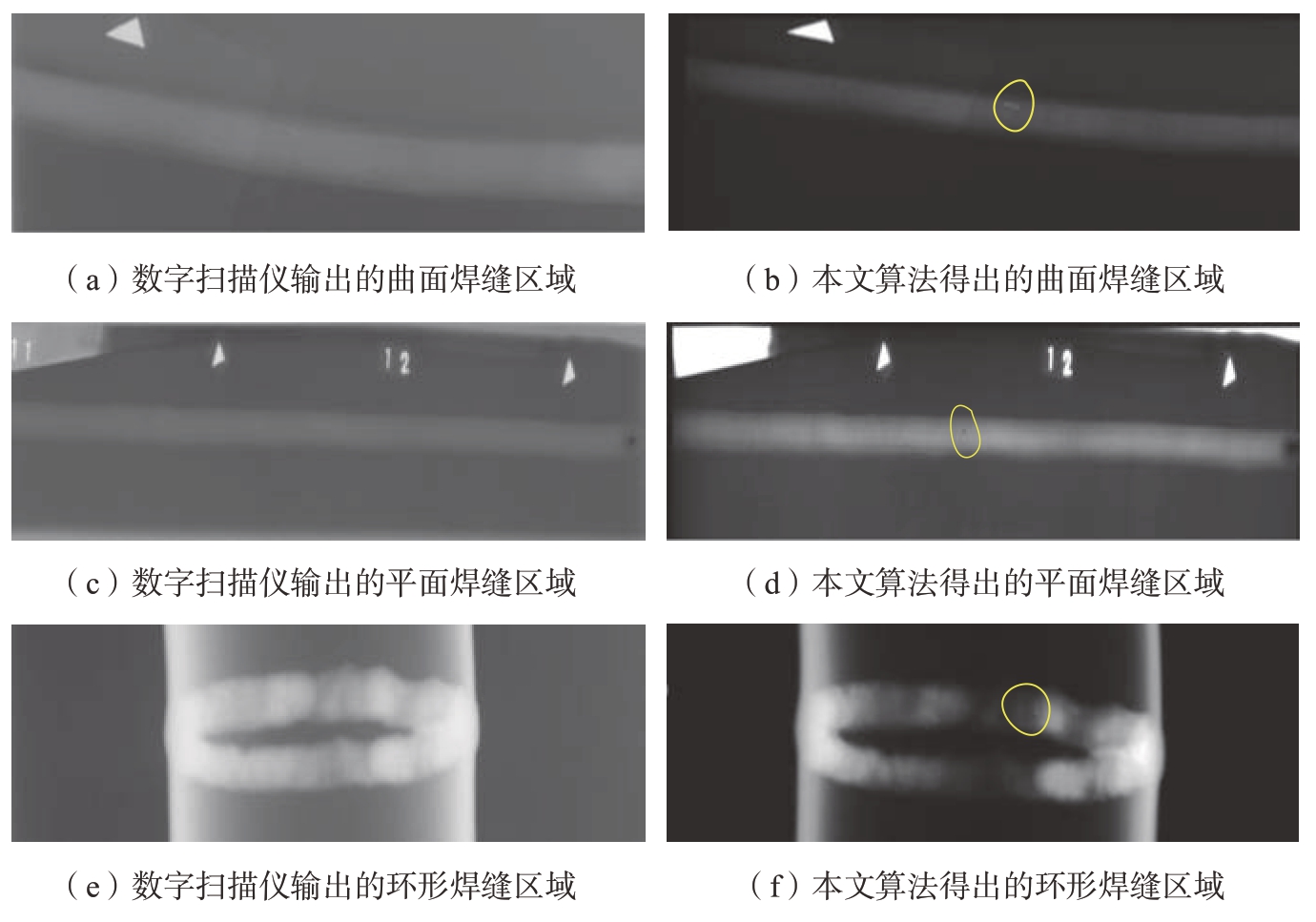

基于本文提出的X射线胶片数字化算法对不同大型零件焊缝区域胶片进行数字化处理,通过数字化网络结构的运算后输出曝光时间最佳且经过滤波处理后的数字化图像,将本文中的数字化结果与现有VIDAR胶片数字化仪的数字图像进行对比,不同对象的数字化结果如图6所示。图6(a)、(c)和(e)分别为数字扫描仪输出的曲面焊缝区域、平面焊缝区域和环形焊缝区域数字化图像;图6(b)、(d)和(f)分别为本文数字化算法得出的曲面焊缝区域、平面焊缝区域和环形焊缝区域数字化图像。通过对比可知,本文算法能够得到更加清晰的缺陷图像,缺陷区域具有较大的分辨率与更丰富的语义信息,有利于进行下一步焊缝缺陷的识别与检测。

图6 数字化结果对比

Fig.6 Comparison of digital results

3.2 焊缝数字化图像缺陷检测

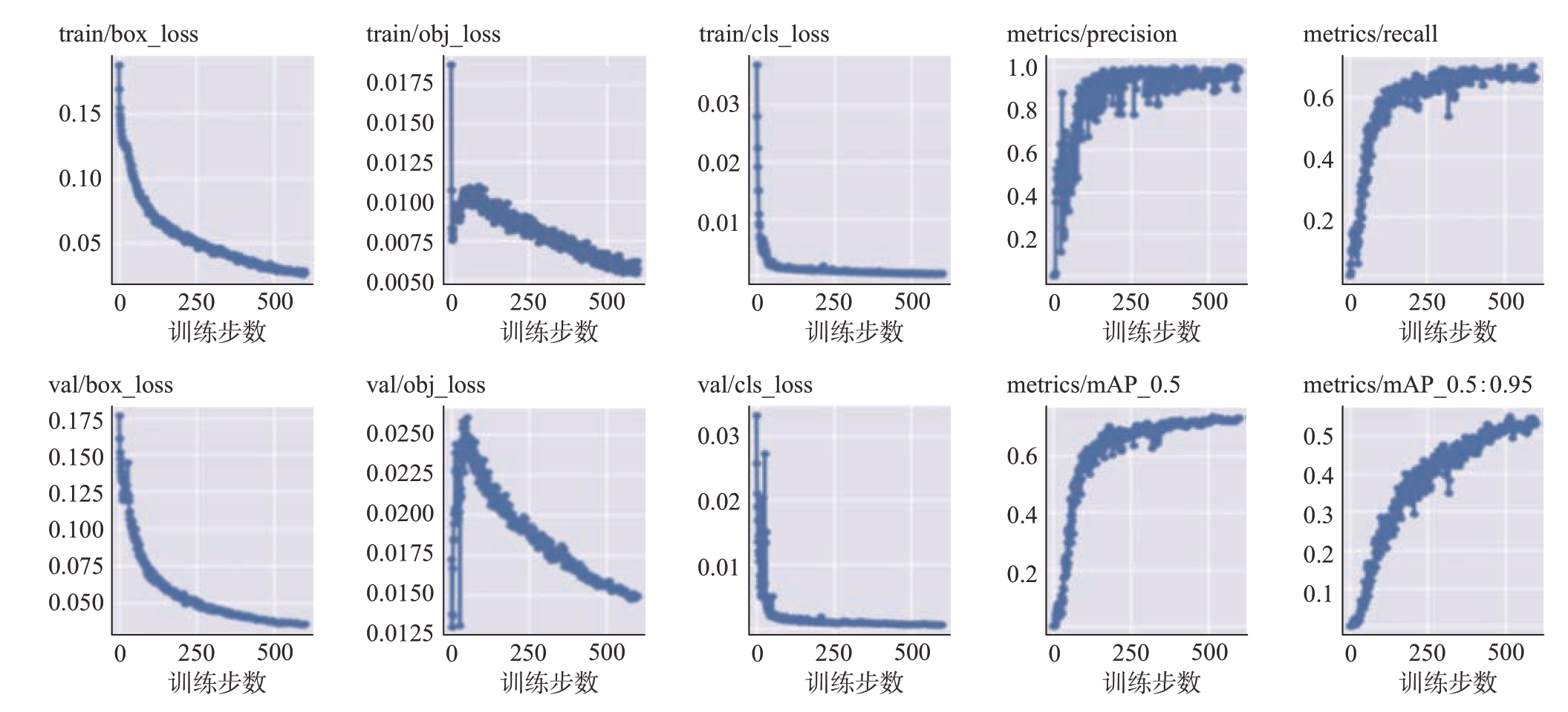

在3.1 的试验中,对2000 张底片进行了数字化处理,得到了24000 张图像。把13800 张图片放入网络,在训练之前,首先对图片进行图像处理运算来扩展图像的数量。通过图像预处理算法可以将一个图像生成另外两个同尺寸增强图像,最终得到41400张图片用来训练和测试。将图片的缺陷分为夹气、夹钨和裂缝3 类,使用图像标注工具“LabelImg”对这些图像进行标注,然后将“LabelImg”获取的真实值注释转换为网络接受的格式。通过以上步骤,创建了X 射线胶片数字化图像数据集,其中包含图像和相应的标签文件。对于每一类缺陷对应的数据集按照8∶1∶1 的比例划分为训练集、测试集和预测集。为了保证预测结果的准确性与科学性,设置各模型训练与优化的超参数为相同数值,优化器则选用随机梯度下降算法,动量值设置为0.9,权重衰减系数设为10–5,损失函数选择交叉熵损失函数,初始学习率设置为0.001。根据测试数据在模型输出的不确定性区间的分布情况,判断焊缝存在该类型缺陷的概率大小,从而确定该焊缝图像中是否含有缺陷,输出焊缝种类、尺寸信息。计算该图像中判别为缺陷区域的个数,等于0 则为合格品,大于0 则为瑕疵品。如图7所示,缺陷检测网络训练过程中针对3类缺陷分类预测收敛情况、模型的分类精度及召回率,其中,train为训练集,val为测试集;box_loss、obj_los、cls_loss 分别为定位、置信度、分类损失函数;precision、recall 和mAP 分别代表目标识别的评价指标准确率、召回率和平均均值精度,其中,mAP_0.5和mAP_0.5∶0.95 分别表示交并比IoU>0.5 和IoU=0.5∶0.95 情况下的值。

图7 缺陷检测网络训练情况

Fig.7 Training results of defect detection network

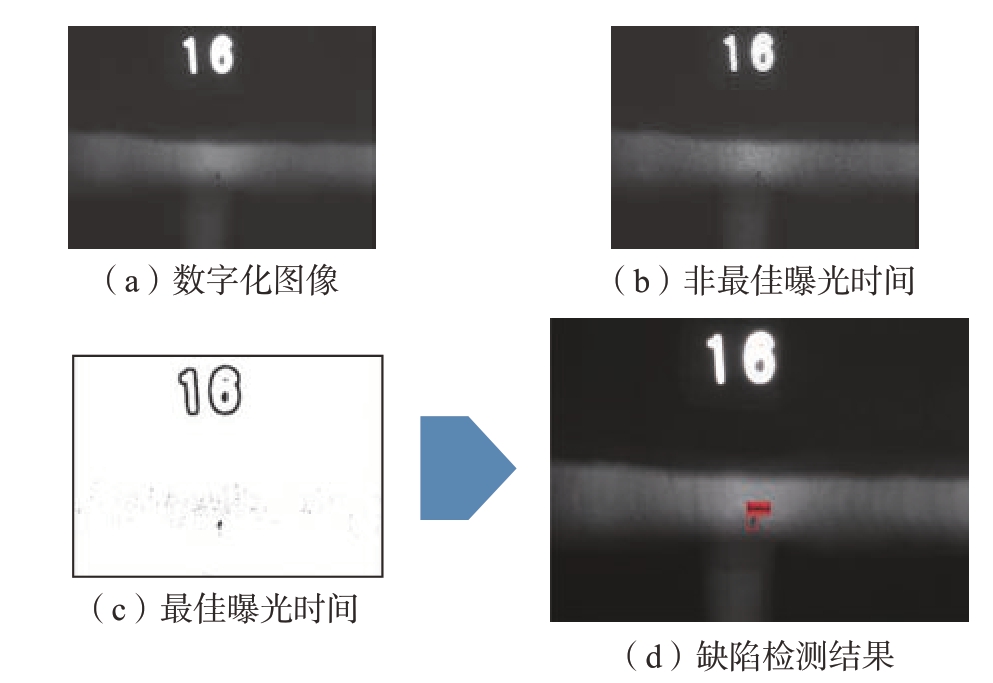

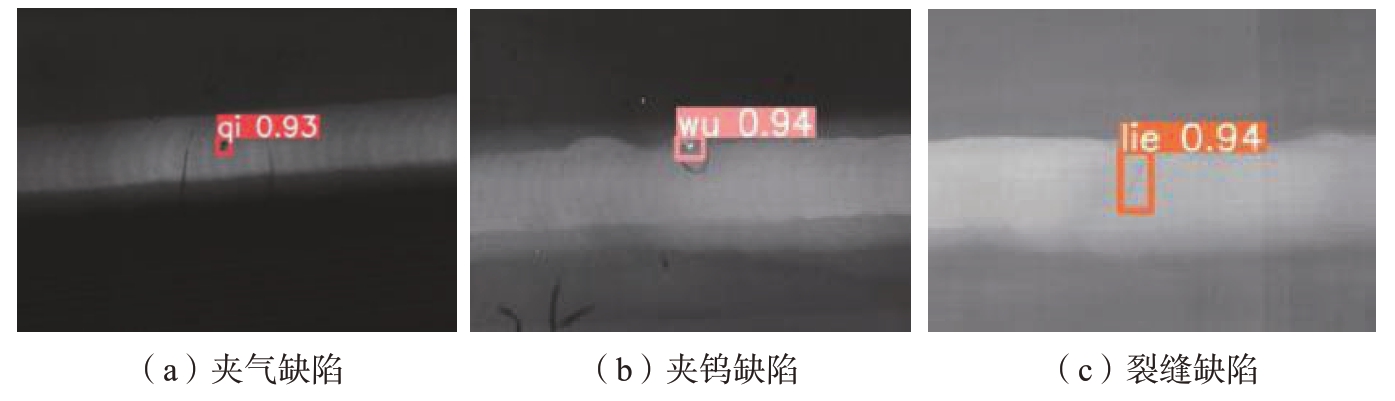

由图7 可知,3 类缺陷检测模型在训练与测试数据集上曲线趋势基本一致,故在焊缝缺陷检测问题上可以通过本文所提出的检测网络模型在测试数据上的表现判断该模型的优劣。通过观察图7 中val 标题下3类不同模型的损失函数曲线趋势可知,500 轮训练后模型在测试数据集上的表现开始趋于平稳,说明损失函数已经接近极小值,模型达到收敛。完成缺陷检测模型训练后,输入预测集图像进测试。预测集中某一缺陷检测结果如图8所示。图8(a)是本文数字化方法直接得到的数字图像,图8(b)和(c)为增强滤波处理后的图像,可以看出缺陷与焊缝的对比得到了改善。缺陷检测网络的缺陷检测结果如图8(d)所示,包围盒的大小与缺陷相同。本文提出的缺陷检测网络对于焊缝中3 类缺陷的识别结果如图9所示,对各缺陷皆做出了正确识别,验证了该算法的有效性与可靠性。

图8 缺陷检测网络输入图像与缺陷检测结果

Fig.8 Defect detection network input image and defect detection results

图9 本文缺陷检测网络焊缝缺陷检测结果

Fig.9 Results of weld defect detection based on defect detection network of this paper

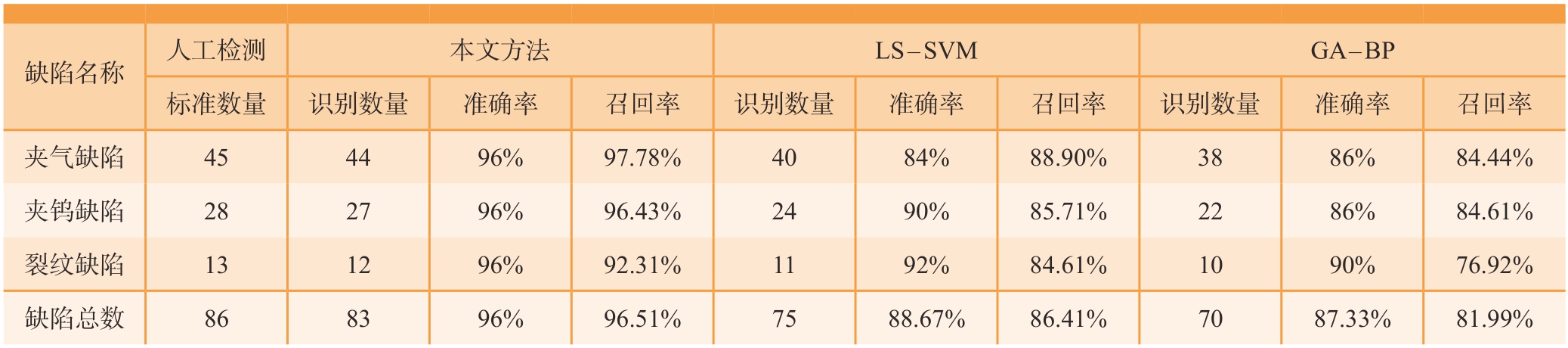

为了更直观地验证网络检测效果,针对每一类缺陷,随机选择50张焊缝胶片,进行数字化及缺陷识别,得到的缺陷识别准确率与召回率结果如表1所示。试验中将专业射线图像检测人员人工判定的结果作为标准结果,进行检测结果的对比统计,同时以常用的传统分类方法最小二乘支持向量机(Least squares support vector machine,LS–SVM)和基于遗传算法优化的BP神经网络(Genetic algorithms back propagation,GA–BP)算法进行缺陷识别,作为算法的对照组。在LS–SVM 模型中,采用径向基函数为核函数,基于网格搜索实现参数选择,同时使用最小输出编码方案。对照组的GA–BP 模型网络结构为单隐层神经网络,隐藏层神经元数为10,算法的学习率与epoch 分别设置为0.01 和6000。通过表1 可知,LS–SVM 针对焊缝缺陷识别的准确率为88.67%,GA–BP 算法针对焊缝缺陷识别的准确率为87.33%,而本文提出的焊缝缺陷检测网络对焊缝中的夹气、夹钨及裂纹缺陷的检测准确率可达96%,召回率可达96.51%,远大于对照组的两类方法,且缺陷识别的准确率与专业人员的人工检测结果高度吻合,能够满足航天产品缺陷识别召回率90%、准确率90%的技术要求。基于以上分析可知,支持向量机更合适小样本,但支持向量机与BP 神经网络属于浅层网络[15],与深层网络(本文网络结构)相比特征提取能力较弱。本文所提X 射线图像焊缝缺陷检测算法能够较高质量地满足检测准确性要求,能胜任大型零件X 射线图像焊缝缺陷的识别任务。

表1 不同检测方法检测结果汇总表

Table 1 Summary table of results of different detection methods

缺陷名称人工检测本文方法LS–SVMGA–BP标准数量识别数量准确率召回率识别数量准确率召回率识别数量准确率召回率夹气缺陷4544 96%97.78%40 84%88.90%38 86%84.44%夹钨缺陷2827 96%96.43%24 90%85.71%22 86%84.61%裂纹缺陷1312 96%92.31%11 92%84.61%10 90%76.92%缺陷总数8683 96%96.51%75 88.67%86.41%70 87.33%81.99%

4 结论

本文以大型零件X 射线胶片为研究对象,建立了X 射线焊缝数字化图像数据集,标注了航天大型零件焊缝中的3 类常见缺陷,实现了零件焊缝区域X 射线胶片的数字化及缺陷检测识别。采用全卷积神经网络结构设计了一种X 射线胶片图像的数字化模型,能够自动获取具有最佳曝光时间参数的数字化图像,并提取焊缝区域。为了实现X 射线数字化图像中小目标缺陷检测,基于轻量级MoGaA 网络并结合分解卷积思想设计出了MoGaA 主干网络结构。试验结果表明,本文提出的X射线胶片数字化算法相对现有方法能够得到更加清晰的缺陷图像,缺陷区域具有较大的分辨率与更丰富的语义信息,本文设计的缺陷检测网络相对于其他传统缺陷检测算法,具有更高的缺陷识别能力,检测3 类缺陷的评价准确率可达96%。本文算法能够准确实现X 射线图像小目标焊缝缺陷识别,改进了现有X 射线图像小目标检测效果,促进了人工智能在航天领域的应用。

[1]王飞,朱建江.机器视觉在复杂环境下焊接缺陷检测的应用研究[J].焊接技术,2017,46(5) :127–133.WANG Fei,ZHU Jianjiang.Application of machine vision in welding defect detection in complex environment[J].Welding Technology,2017,46(5) :127–133.

[2]章清乐,刘松平,刘菲菲.大型复合材料蜂窝夹芯结构X 射线数字成像自动化快速扫描检测技术[J].航空制造技术,2022,65(13):78–83.ZHANG Qingle,LIU Songping,LIU Feifei.Fast inspection of large-scale composite honeycomb sandwich structures using automated X-ray digital radiography scanning imaging technique[J].Aeronautical Manufacturing Technology,2022,65(13):78–83.

[3]姚罡,张杰,陆业航,等.X 射线法测试钛合金结构件残余应力的适用性研究[J].航空制造技术,2017,60(14):93–96.YAO Gang,ZHANG Jie,LU Yehang,et al.Applicability research on measuring residual stress of titanium alloy by X-ray test[J].Aeronautical Manufacturing Technology,2017,60(14):93–96.

[4]吴一全,沈毅,刚铁,等.基于二维对称Tsallis 交叉熵的小目标图像阈值分割[J].仪器仪表学报,2011,32(10):2161–2167.WU Yiquan,SHEN Yi,GANG Tie,et al.Thresholding for small target image based on 2-D symmetric Tsallis cross entropy[J].Chinese Journal of Scientific Instrument,2011,32(10):2161–2167.

[5]陈本智,方志宏,夏勇,等.基于X射线图像的厚钢管焊缝中气孔缺陷的自动检测[J].计算机应用,2017,37(3):849–853.CHEN Benzhi,FANG Zhihong,XIA Yong,et al.Automatic detection of blowholes defects in X-ray images of thick steel pipes[J].Journal of Computer Applications,2017,37(3):849–853.

[6]HE D,XU K,ZHOU P.Defect detection of hot rolled steels with a new object detection framework called classification priority network[J].Computers &Industrial Engineering,2019,128:290–297.

[7]YU L Y,WANG Z,DUAN Z J.Detecting gear surface defects using backgroundweakening method and convolutional neural network[J].Journal of Sensors,2019:3140980.

[8]MEI S,WANG Y D,WEN G J.Automatic fabric defect detection with a multiscale convolutional denoising autoencoder network model[J].Sensors,2018,18(4):1064.

[9]BIANCO S,BUZZELLI M,SCHETTINI R.Multiscale fully convolutional network for image saliency[J].Journal of Electronic Imaging,2018,27(5):051221.

[10]LU Q S,LIU C H,JIANG Z Q,et al.G–CNN:Object detection via grid convolutional neural network[J].IEEE Access,2017,5:24023–24031.

[11]杨作廷,阮萍,翟波.基于图像熵的高动态范围场景的自动曝光算法[J].光子学报,2013,42(6):742–746.YANG Zuoting,RUAN Ping,ZHAI Bo.Auto-exposure algorithm for scenes with high dynamic range based on image entropy[J].Acta Photonica Sinica,2013,42(6):742–746.

[12]CHU X X,ZHANG B,XU R J.MoGA:searching beyond MobileNetV3[C]//ICASSP 2020–2020 IEEE International Conference on Acoustics,Speech and Signal Processing (ICASSP).Barcelona,2020:4042–4046.

[13]陶晓天,何博侠,张鹏辉,等.基于深度学习的航天密封圈表面缺陷检测[J].仪器仪表学报,2021,42(1):199–206.TAO Xiaotian,HE Boxia,ZHANG Penghui,et al.Surface defect detection of aerospace sealing rings based on deep learning[J].Chinese Journal of Scientific Instrument,2021,42(1):199–206.

[14]CHOLLET F.Xception:Deep learning with depthwise separable convolutions[C]//2017 IEEE Conference on Computer Vision and Pattern Recognition (CVPR).Honolulu,2017:1800–1807.

[15]HE K M,ZHANG X Y,REN S Q,et al.Deep residual learning for image recognition[C]//2016 IEEE Conference on Computer Vision and Pattern Recognition (CVPR).Las Vegas,2016:770–778.